「報酬予測」の版間の差分

Junko kurahashi (トーク | 投稿記録) 細編集の要約なし |

Hiroyukinakahara (トーク | 投稿記録) 細編集の要約なし |

||

| (3人の利用者による、間の28版が非表示) | |||

| 1行目: | 1行目: | ||

英:Reward prediction | 英:Reward prediction | ||

{{box|text= | {{box|text= 報酬予測とは、ヒトを含む動物が、特定の情報から将来の報酬を予測することである。ここで「報酬」とは、食料・水などに代表される正の動機や感情を生む物質・出来事・状況・活動の総称であり、動物はより多くの報酬を得るために報酬を予測し、それにもとづく反応や行動をみせる。また、報酬予測にかかわる神経活動は、意思決定やそれにともなう学習と深くかかわることがわかっている。ここでは、動物がみせる報酬予測にもとづく反応と行動選択、そして報酬予測にかかわる神経活動について述べる。}} | ||

==報酬予測にかかわる行動== | ==報酬予測にかかわる行動== | ||

報酬の代表である食料・水は、動物の生存に不可欠であり、より多くの報酬を得るために反応・行動することは、種の存続に有利に働く。そのため、特定の情報から報酬の獲得が予測できる状況にあっては、動物は報酬を予測し、それにともなう様々な反応と行動選択をみせる。 | |||

実際に動物が報酬を予測していることを示唆する反応と行動選択は、[[パブロフ型条件づけ]](pavlovian conditioning、または古典的条件づけ、classical conditioning)、[[道具的条件づけ]](instrumental conditioning、またはオペラント条件づけ、operant conditioning)、また遅延反応課題(delayed response task)などの選択課題の実験に端的に表れる。また、報酬予測の神経基盤に関する研究においても、多くの場合これらの実験パラダイムが用いられる。以下では、パブロフ型条件づけ、道具的条件づけ、そして遅延反応課題の実験にみられる報酬予測に関連した反応と行動選択について説明する。 | |||

===パブロフ型条件づけ課題にみられる反応=== | |||

パブロフ型条件づけの実験では、動物が報酬を予測していることを支持するj受動的な反応がみられる。パブロフ型条件づけでは、動物が本来意味を持たない外界の情報(刺激)と報酬の連合を学習する。たとえば、有名な「パブロフの犬」の実験では、イヌがベルの音を聞いた直後に餌が与えられることを何度も経験するうちに、ベルの音を聞くだけでヨダレをだすようになる。これは、イヌがベルの音と餌の獲得の連合を学習したものと解釈できる。ここでは餌が報酬であり、無条件(学習を必要とせず)にヨダレという反応を引き起こすことから、無条件刺激(unconditioned stimulus、US)と呼ばれる。また、ベルの音は学習の結果ヨダレの反応を引き起こすことから、条件刺激(conditioned stimulus、CS)と呼ばれる。動物が本来意味を持たないCSに対してUSが引き起こす反応を獲得することは、動物がCSをもとに報酬が得られることを予測するようになったためと考えられる。 | |||

さらに、パブロフ型条件づけ課題では、動物が報酬を期待していることを示す自発的反応もみられる。たとえば、CSと報酬の獲得を学習した動物は、CSの提示に際してCSや報酬の提示場所へ近づく接近反応(approach response)をみせる<ref name=bouton>'''Mark E Bouton'''<br>Learning and behavior: A contemporary synthesis Second Edition<br>''Sinauer Associates'': 2007</ref>。また、ジュースを報酬として与える課題では、報酬が与えられる前に飲み口を予期的に舐めるリッキング行動がみられる<ref name=tsutsui>'''筒井健一郎、大山佳'''<br>報酬期待の神経科学、社会脳シリーズ第5巻・報酬を期待する脳<br>''苧坂直行編、新曜社(東京)'':2014</ref>。これらの報酬獲得のための準備行動も、動物がCSにもとづき報酬を予測していることを支持している。 | |||

パブロフ条件づけにみられる報酬予測にもとづく反応はどのように学習されるのだろうか? ここでは、パブロフ型条件づけにおける動物の反応をよく説明する「レスコーラ・ワグナーの学習則」を紹介する<ref>'''Peter Dayan, L. F. Abbott'''<br>Theoretical Neuroscience: Computational and Mathematical Modeling of Neural Systems <br>''The MIT Press'': 2001</ref> <ref>'''Peter Dayan, Hiroyuki Nakahara'''<br>Models and Methods for Reinforcement Learning, The Stevens’ Handbook of Experimental Psychology<br>''Wiley'': 2017</ref>。 | |||

レスコーラ・ワグナーの学習則は、実際に得られた報酬量と予期された報酬量の差分である「報酬予測誤差(reward prediction error)」を学習信号として、今までの予期報酬を新たな予期報酬へ更新する: | |||

<i>新たな予期報酬 = 今までの予期報酬 + 学習係数 × 報酬予測誤差</i> | <i>新たな予期報酬 = 今までの予期報酬 + 学習係数 × 報酬予測誤差</i> | ||

上式からわかるように、新たな予期報酬は、報酬予測誤差が正であれば(報酬が予想していたより多ければ)上方に、負であれば(報酬が予想していたより少なければ)下方に修正される。 | |||

レスコー・ラワグナーの学習則は、報酬予測誤差が小さくなるほど学習が遅くなり、誤差がないときに学習は起こらないことを予想している。これらのことは、パブロフ型条件づけの行動実験で実際に確認されている。たとえば、光が点灯すると餌がもらえることを学習したラットに対し、光と音を同時に呈示した後に餌を与えることを繰り返しても、音に対する学習は起こらない。これは「阻止効果(blocking effect)」と呼ばれており<ref name=bouton />、レスコー・ラワグナーの学習則から考えれば、先に学習された光が餌の獲得を完全に予測するため、音が予測する餌の報酬予測誤差がゼロとなるためと解釈できる。 | |||

=== | ===道具的条件づけ課題と行動選択=== | ||

道具的条件づけの実験では、動物が報酬を予測していることを支持する行動選択がみられる。パブロフ型条件づけの実験パラダイムでは、動物自らの反応によらず受動的に報酬が与えられるため、動物の積極的な行動選択を調べることはできない。これに対して、道具的条件づけの実験パラダイムでは、特定の環境や刺激に対して選択される行動次第で得られる報酬やその大きさに違いが生まれる。道具的条件づけの実験では、動物はより大きな報酬をもたらす行動の頻度を増加させる。たとえば、ソーンダイクが行った実験では、パズルボックスの中に閉じ込められたネコが試行錯誤を繰り返すうちに、内側に設置された紐を引いてパズルボックスの外に出て餌を獲得することを学習する。このような学習がおこることは、動物が行動の結果得られる報酬を予測しているためと考えられる。 | |||

===遅延反応課題にみられる行動選択と反応=== | |||

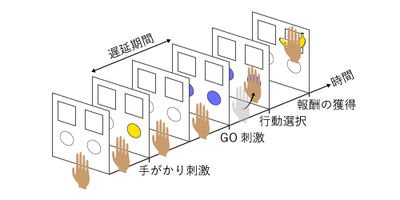

[[ファイル:報酬予測0.png|thumb|400px|'''図1.遅延反応課題のイメージ''']] | |||

報酬予測に関連した行動を調べるためによく用いられる課題に、遅延選択課題がある(図1)。たとえば、サルが学習する典型的な遅延選択課題では、まず左右どちらかの手がかり刺激(cue stimulus)が点灯する。そして、遅延期間を経たのち、サルにはGO刺激(GO stimulus)の点灯に際して左右どちらかのボタンを押すことが求められる。このとき、刺激が呈示されたのと同じ側のボタンを押した場合には報酬として餌やジュースが与えられるが、逆側を押した場合には報酬が与えられない。 | |||

サルはこのような課題を繰り返すうちに、手がかり刺激に応じて左右のボタンを押して報酬を得ることを学習する。さらに、サルの好物であるバナナを報酬として遅延選択課題を行った場合、突然報酬をレタスに変更すると、サルは驚きと怒りをみせる<ref>'''O L Tinklepaugh'''<br>An experimental study of representative factors in monkeys.<br>''J. Comp. Psychol.'': 1928, (8);197-236</ref>。これらのことは、道具的条件づけの場合と同様、サルが特定の行動の結果得られる報酬を予測していることを示している <ref name=watanabe1996><pubmed> 8757133 </pubmed></ref>。 | |||

また、同様の実験パラダイムでサルが二種類の手がかり刺激がそれぞれ異なる種類のジュースに対応していることを学習した場合、嗜好性の高い報酬が得られる試行において、サルはより短い反応時間かつより高い正当率で行動選択を行い、また予期的なリッキング行動の持続時間も長くなる<ref name=hassani2001><pubmed> 11387394 </pubmed></ref>。これらのこともまた、学習の結果サルが行動の結果得られる報酬を予測していることを支持している。 | |||

==報酬予測にかかわる神経活動== | ==報酬予測にかかわる神経活動== | ||

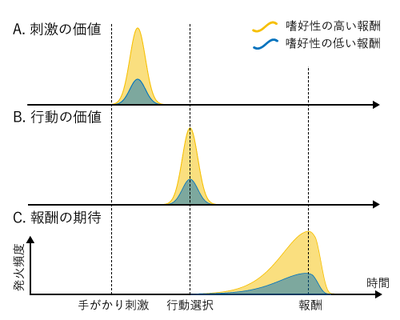

[[ファイル:報酬予測1.png|thumb|400px|''' | [[ファイル:報酬予測1.png|thumb|400px|'''図2.遅延反応課題に関連して、報酬予測にかかわる異なる情報が符号化されたニューロン活動のイメージ'''<ref name=schultz2015 />(A)報酬を予測する刺激の価値を反映したニューロンの活動。(B)報酬をもたらす行動の価値を反映したニューロンの活動。(C)報酬への期待を反映したニューロンの活動。黄色と青色は、それぞれ嗜好性の高い報酬と低い報酬が予測される場合にみられる単一ニューロンの反応。]] | ||

報酬予測にかかわる神経活動は、一般に[[報酬系]]と呼ばれる脳領域群をはじめとして、多様な脳領域でみられる<ref name=tsutsui | 報酬予測にかかわる神経活動は、一般に[[報酬系]]と呼ばれる脳領域群をはじめとして、多様な脳領域でみられる<ref name=tsutsui /> <ref name=schultz2006 /> <ref name=hikosaka2006 />。ここでは、報酬予測にかかわる神経活動を、報酬を予測する刺激の価値を反映した神経活動(図2A)、報酬をもたらす行動の価値を反映した神経活動(図2B)、動物の報酬への期待を反映した神経活動(図2C)に分類し<ref name=tsutsui /> <ref name=schultz2015 />、これらの神経活動がみられる領域を紹介する。そして最後に、刺激や行動の価値を反映したニューロンの活動を調整する学習信号と考えられているドーパミンニューロンの活動を紹介する。 | ||

===刺激や行動の価値の神経活動=== | ===刺激や行動の価値の神経活動=== | ||

動物の脳では、刺激や行動の「価値(value)」を反映するような神経活動が報告されている<ref name=tsutsui /> <ref name= | 動物の脳では、刺激や行動の「価値(value)」を反映するような神経活動が報告されている<ref name=tsutsui /> <ref name=schultz2006 /> <ref name=hikosaka2006 /> <ref name=schultz2015><pubmed> 26109341 </pubmed></ref>。 | ||

パブロフ型条件づけでは、本来意味を持たない刺激が、刺激と報酬の連合が学習されることで未来の報酬を予測する価値の高い情報となる。このような学習によって増加した刺激の価値を反映するように、報酬を予測する刺激が呈示された直後に予想される報酬の好ましさに応じた活動の増大をみせるニューロンがみつかっている(図2B)。 | |||

このような刺激の価値を反映した神経活動は、眼窩前頭皮質<ref name=Padoa-Schioppa2006><pubmed> 16633341 </pubmed></ref> <ref><pubmed> 8734596 </pubmed></ref> <ref name=Tremblay1999><pubmed> 10227292 </pubmed></ref> <ref name=rosech2004><pubmed> 15073380 </pubmed></ref>、線条体 <ref name=kawagoe1998><pubmed> 10196532 </pubmed></ref> <ref name=hassani2001 /> <ref><pubmed> | |||

6589643 </pubmed></ref> <ref name=cromwell2003><pubmed> | |||

12611937 </pubmed></ref>、扁桃体 <ref><pubmed> 3193171 </pubmed></ref> <ref><pubmed> 16482160 </pubmed></ref>、黒質緻密部<ref><pubmed> 3794777</pubmed></ref>、上丘<ref name=ikeda2003 />などで報告されている。 | |||

また、道具的条件づけでは、本来意味を持たない行動が、行動と報酬の連合が学習によってより多くの報酬をもたらす価値の高い行動となる。このような学習にともなう行動の価値の増加を反映するように、報酬をもたらす行動が遂行される前後で予想される報酬の好ましさに応じた活動の増大をみせるニューロンがみつかっている。 | |||

このような行動の価値を反映した神経活動は、線条体<ref name=hassani2001 /> <ref name=cromwell2003 /><ref><pubmed> | |||

16311337 </pubmed></ref> <ref name name=lauwereyns2002><pubmed> 12140557 </pubmed></ref> <ref><pubmed> | 16311337 </pubmed></ref> <ref name name=lauwereyns2002><pubmed> 12140557 </pubmed></ref> <ref><pubmed> | ||

14602819 </pubmed></ref> <ref><pubmed> 18466754 </pubmed></ref> | 14602819 </pubmed></ref> <ref><pubmed> 18466754 </pubmed></ref> <ref name=nakamura2012 />、後頭頂皮質<ref><pubmed> 15205529 </pubmed></ref>などで報告されている。 | ||

また、刺激や行動の価値を反映した神経活動には、期待される報酬の量や好ましさの情報とともに、報酬を予測する刺激の知覚情報、あるいは報酬を獲得するための行動にかかわる情報が符号化されている場合が多い<ref name=hikosaka2006 /> <ref name=schultz2015 />。たとえば、サルの遅延反応課題中の神経活動を計測した実験では、手がかり刺激が視野の対側に呈示される試行でより大きな活動の高まりをみせるニューロンが線条体でみつかっている<ref name=kawagoe1998 /> <ref name=lauwereyns2002 /> <ref name=nakamura2012 />。このような報酬および報酬獲得のための行動関連情報を含む報酬期待の神経信号は、報酬獲得のために適切な行動を遂行することを可能にしていると考えられる<ref name=hikosaka2006 />。 | |||

===報酬期待の神経活動=== | ===報酬期待の神経活動=== | ||

これまでの多くの実験から、動物の報酬への期待を反映するような神経活動が報告されている<ref name=tsutsui /> <ref name= | これまでの多くの実験から、動物の報酬への期待を反映するような神経活動が報告されている<ref name=tsutsui /> <ref name=hikosaka2006><pubmed> 16424448 </pubmed></ref> <ref name=schultz2006 />。このような神経活動は、報酬を予測する刺激が呈示された後、報酬が獲得されるまでの間に持続的な増大をみせ、さらに活動の増大幅は予測された報酬の量や好ましさを反映するという特徴を持つ<ref name=tsutsui /> <ref name=schultz2006><pubmed> 16318590 </pubmed></ref>(図2C)<ref name=schultz2015 />。 | ||

報酬期待の神経活動がみられる脳領野は多岐にわたっている。大脳皮質下の領域では、線条体<ref><pubmed> 1464759 </pubmed></ref> <ref name=hikosaka2006 /> <ref><pubmed> 2723722 </pubmed></ref> <ref name=kawagoe1998 /> <ref><pubmed> 8867118 </pubmed></ref>、淡蒼球<ref><pubmed> 23177966 </pubmed></ref>、扁桃体 <ref name=schoenbaum1998><pubmed> 10195132 </pubmed></ref>、中脳ドーパミン領域(腹側被蓋野<ref name=cohen2012><pubmed> 22258508 </pubmed></ref>・黒質網様部<ref><pubmed> 11896175 </pubmed></ref>)、上丘<ref name=ikeda2003><pubmed> 12925282 </pubmed></ref>、脚橋被蓋核<ref><pubmed> 19369554 </pubmed></ref>などで報酬期待の神経活動がみられる。また、大脳皮質では、背外側前頭前皮質<ref name=watanabe1996 /> <ref><pubmed> 3971157 </pubmed></ref> <ref><pubmed> 10571234 </pubmed></ref> <ref name=rosech2003><pubmed> 12801905 </pubmed></ref>、眼窩前頭前皮質 <ref name=Tremblay1999 /> <ref name=schoenbaum1998 />、後頭頂皮質<ref><pubmed> 10421364 </pubmed></ref> <ref><pubmed> 15205529 </pubmed></ref>、前帯状回皮質<ref><pubmed> 12040201 </pubmed></ref>、島皮質<ref><pubmed> 16979828 </pubmed></ref> <ref><pubmed> 22402653 | |||

</pubmed></ref>、運動前野<ref name=rosech2004 /> <ref name=rosech2003 />などで報酬期待の神経活動が報告されている。 | |||

報酬期待の神経活動は、刺激や行動の価値を反映した神経活動より時間的に遅れて高まる。このことは、報酬期待を反映した持続的な活動が、刺激や行動の価値を反映した神経活動によって引き起こされていることを示唆している<ref name=tsutsui />。刺激や行動の価値を表現した神経活動が、どのように報酬期待の神経活動を調節しているかについては、今後の研究が俟たれる。 | |||

===ドーパミンニューロンの活動と報酬予測誤差=== | ===ドーパミンニューロンの活動と報酬予測誤差=== | ||

これまで報酬予測にかかわる学習の神経科学的研究は、[[ドーパミンニューロン]]のphasic活動が強化学習で一般に報酬予測誤差と呼ばれる学習信号を符号化しているとする「ドーパミン報酬予測誤差仮説」<ref name=schultz1997><pubmed> 9054347 </pubmed></ref>に牽引されてきた。 | |||

ドーパミン報酬予測誤差仮説を支持する研究結果として、たとえば、サルのドーパミンニューロンの反応が学習に伴い変化することが知られている<ref name=schultz1997 /> <ref><pubmed> 7983508</pubmed></ref>。ドーパミンニューロンは、学習の初期には報酬の獲得にあわせて活動を増大させる。この反応は学習が進むにつれ消失し、報酬を予測する手がかり刺激の呈示直後に活動が増大するようになる。また、予想された報酬が呈示されなかった場合には、報酬が予測された時刻の活動が低下する。これらのことは、ドーパミンニューロンが正負の報酬予測誤差を両方向的に符号化していることを示唆している<ref name=schultz2006 />。さらに、阻止効果の実験でもドーパミンニューロンが強化学習の理論から予見される学習信号を反映した活動をみせることが報告されおり<ref><pubmed> 11452299 </pubmed></ref> <ref><pubmed> 14741107 </pubmed></ref>、近年では[[オプトジェネティクス]]やマイクロスティミュレーションを用いてドーパミンニューロンの活動を人為的に操作すると学習が阻害されることが報告されている<ref><pubmed> 28390863 </pubmed></ref> 。 | |||

近年では、報酬予測誤差を反映するような神経活動が線条体<ref name=oyama2010><pubmed> 20739566 </pubmed></ref>や内側前頭前皮質<ref><pubmed> 17450137 </pubmed></ref>などでも報告されており、また手綱外側核ではドーパミンニューロンとは逆に罰の予測に関連して負の報酬予測誤差を反映するニューロンが報告されている<ref><pubmed> 17522629 </pubmed></ref>。これらの神経活動もなんらかの形で報酬予測に関連する活動の調整に関与しているものと考えられるが、その詳細はまだわかっていない。さらに、報酬予測誤差そのものが脳でどのように計算されているのかという問題も今後の研究が俟たれている<ref name=tsutsui /> <ref name=cohen2012 /> <ref name=nakamura2012><pubmed> 23136434 </pubmed></ref> <ref><pubmed> 23069349 </pubmed></ref> <ref><pubmed> 24463329 </pubmed></ref>。 | |||

ドーパミンニューロンは、前述の刺激や行動の価値を反映した神経活動が報告されている脳領域の多くに投射しており<ref name=hikosaka2006 /> <ref name=schultz2006 />、ドーパミンニューロンの活動によってその投射先で起こるドーパミンの放出はシナプス強度を調節する<ref><pubmed> 11544526 </pubmed></ref> <ref><pubmed> 17367873 </pubmed></ref> <ref><pubmed> 25258080</pubmed></ref>。これらのことは、報酬予測誤差を反映したドーパミン動物の活動が、神経可塑性を介して脳における価値表現を調節していることを示唆している。 | |||

== 関連項目 == | == 関連項目 == | ||

| 80行目: | 79行目: | ||

*[[強化学習]] | *[[強化学習]] | ||

*[[報酬系]] | *[[報酬系]] | ||

*[[ | *[[ドーパミンニューロン]] | ||

== 参考文献 == | == 参考文献 == | ||

<references/> | <references/> | ||

(執筆者:望月泰博、福田玄明、陳冲、中原裕之、担当編集委員:??) | |||

2018年2月7日 (水) 15:36時点における版

英:Reward prediction

報酬予測とは、ヒトを含む動物が、特定の情報から将来の報酬を予測することである。ここで「報酬」とは、食料・水などに代表される正の動機や感情を生む物質・出来事・状況・活動の総称であり、動物はより多くの報酬を得るために報酬を予測し、それにもとづく反応や行動をみせる。また、報酬予測にかかわる神経活動は、意思決定やそれにともなう学習と深くかかわることがわかっている。ここでは、動物がみせる報酬予測にもとづく反応と行動選択、そして報酬予測にかかわる神経活動について述べる。

報酬予測にかかわる行動

報酬の代表である食料・水は、動物の生存に不可欠であり、より多くの報酬を得るために反応・行動することは、種の存続に有利に働く。そのため、特定の情報から報酬の獲得が予測できる状況にあっては、動物は報酬を予測し、それにともなう様々な反応と行動選択をみせる。

実際に動物が報酬を予測していることを示唆する反応と行動選択は、パブロフ型条件づけ(pavlovian conditioning、または古典的条件づけ、classical conditioning)、道具的条件づけ(instrumental conditioning、またはオペラント条件づけ、operant conditioning)、また遅延反応課題(delayed response task)などの選択課題の実験に端的に表れる。また、報酬予測の神経基盤に関する研究においても、多くの場合これらの実験パラダイムが用いられる。以下では、パブロフ型条件づけ、道具的条件づけ、そして遅延反応課題の実験にみられる報酬予測に関連した反応と行動選択について説明する。

パブロフ型条件づけ課題にみられる反応

パブロフ型条件づけの実験では、動物が報酬を予測していることを支持するj受動的な反応がみられる。パブロフ型条件づけでは、動物が本来意味を持たない外界の情報(刺激)と報酬の連合を学習する。たとえば、有名な「パブロフの犬」の実験では、イヌがベルの音を聞いた直後に餌が与えられることを何度も経験するうちに、ベルの音を聞くだけでヨダレをだすようになる。これは、イヌがベルの音と餌の獲得の連合を学習したものと解釈できる。ここでは餌が報酬であり、無条件(学習を必要とせず)にヨダレという反応を引き起こすことから、無条件刺激(unconditioned stimulus、US)と呼ばれる。また、ベルの音は学習の結果ヨダレの反応を引き起こすことから、条件刺激(conditioned stimulus、CS)と呼ばれる。動物が本来意味を持たないCSに対してUSが引き起こす反応を獲得することは、動物がCSをもとに報酬が得られることを予測するようになったためと考えられる。

さらに、パブロフ型条件づけ課題では、動物が報酬を期待していることを示す自発的反応もみられる。たとえば、CSと報酬の獲得を学習した動物は、CSの提示に際してCSや報酬の提示場所へ近づく接近反応(approach response)をみせる[1]。また、ジュースを報酬として与える課題では、報酬が与えられる前に飲み口を予期的に舐めるリッキング行動がみられる[2]。これらの報酬獲得のための準備行動も、動物がCSにもとづき報酬を予測していることを支持している。

パブロフ条件づけにみられる報酬予測にもとづく反応はどのように学習されるのだろうか? ここでは、パブロフ型条件づけにおける動物の反応をよく説明する「レスコーラ・ワグナーの学習則」を紹介する[3] [4]。

レスコーラ・ワグナーの学習則は、実際に得られた報酬量と予期された報酬量の差分である「報酬予測誤差(reward prediction error)」を学習信号として、今までの予期報酬を新たな予期報酬へ更新する:

新たな予期報酬 = 今までの予期報酬 + 学習係数 × 報酬予測誤差

上式からわかるように、新たな予期報酬は、報酬予測誤差が正であれば(報酬が予想していたより多ければ)上方に、負であれば(報酬が予想していたより少なければ)下方に修正される。

レスコー・ラワグナーの学習則は、報酬予測誤差が小さくなるほど学習が遅くなり、誤差がないときに学習は起こらないことを予想している。これらのことは、パブロフ型条件づけの行動実験で実際に確認されている。たとえば、光が点灯すると餌がもらえることを学習したラットに対し、光と音を同時に呈示した後に餌を与えることを繰り返しても、音に対する学習は起こらない。これは「阻止効果(blocking effect)」と呼ばれており[1]、レスコー・ラワグナーの学習則から考えれば、先に学習された光が餌の獲得を完全に予測するため、音が予測する餌の報酬予測誤差がゼロとなるためと解釈できる。

道具的条件づけ課題と行動選択

道具的条件づけの実験では、動物が報酬を予測していることを支持する行動選択がみられる。パブロフ型条件づけの実験パラダイムでは、動物自らの反応によらず受動的に報酬が与えられるため、動物の積極的な行動選択を調べることはできない。これに対して、道具的条件づけの実験パラダイムでは、特定の環境や刺激に対して選択される行動次第で得られる報酬やその大きさに違いが生まれる。道具的条件づけの実験では、動物はより大きな報酬をもたらす行動の頻度を増加させる。たとえば、ソーンダイクが行った実験では、パズルボックスの中に閉じ込められたネコが試行錯誤を繰り返すうちに、内側に設置された紐を引いてパズルボックスの外に出て餌を獲得することを学習する。このような学習がおこることは、動物が行動の結果得られる報酬を予測しているためと考えられる。

遅延反応課題にみられる行動選択と反応

報酬予測に関連した行動を調べるためによく用いられる課題に、遅延選択課題がある(図1)。たとえば、サルが学習する典型的な遅延選択課題では、まず左右どちらかの手がかり刺激(cue stimulus)が点灯する。そして、遅延期間を経たのち、サルにはGO刺激(GO stimulus)の点灯に際して左右どちらかのボタンを押すことが求められる。このとき、刺激が呈示されたのと同じ側のボタンを押した場合には報酬として餌やジュースが与えられるが、逆側を押した場合には報酬が与えられない。

サルはこのような課題を繰り返すうちに、手がかり刺激に応じて左右のボタンを押して報酬を得ることを学習する。さらに、サルの好物であるバナナを報酬として遅延選択課題を行った場合、突然報酬をレタスに変更すると、サルは驚きと怒りをみせる[5]。これらのことは、道具的条件づけの場合と同様、サルが特定の行動の結果得られる報酬を予測していることを示している [6]。

また、同様の実験パラダイムでサルが二種類の手がかり刺激がそれぞれ異なる種類のジュースに対応していることを学習した場合、嗜好性の高い報酬が得られる試行において、サルはより短い反応時間かつより高い正当率で行動選択を行い、また予期的なリッキング行動の持続時間も長くなる[7]。これらのこともまた、学習の結果サルが行動の結果得られる報酬を予測していることを支持している。

報酬予測にかかわる神経活動

報酬予測にかかわる神経活動は、一般に報酬系と呼ばれる脳領域群をはじめとして、多様な脳領域でみられる[2] [9] [10]。ここでは、報酬予測にかかわる神経活動を、報酬を予測する刺激の価値を反映した神経活動(図2A)、報酬をもたらす行動の価値を反映した神経活動(図2B)、動物の報酬への期待を反映した神経活動(図2C)に分類し[2] [8]、これらの神経活動がみられる領域を紹介する。そして最後に、刺激や行動の価値を反映したニューロンの活動を調整する学習信号と考えられているドーパミンニューロンの活動を紹介する。

刺激や行動の価値の神経活動

動物の脳では、刺激や行動の「価値(value)」を反映するような神経活動が報告されている[2] [9] [10] [8]。

パブロフ型条件づけでは、本来意味を持たない刺激が、刺激と報酬の連合が学習されることで未来の報酬を予測する価値の高い情報となる。このような学習によって増加した刺激の価値を反映するように、報酬を予測する刺激が呈示された直後に予想される報酬の好ましさに応じた活動の増大をみせるニューロンがみつかっている(図2B)。

このような刺激の価値を反映した神経活動は、眼窩前頭皮質[11] [12] [13] [14]、線条体 [15] [7] [16] [17]、扁桃体 [18] [19]、黒質緻密部[20]、上丘[21]などで報告されている。

また、道具的条件づけでは、本来意味を持たない行動が、行動と報酬の連合が学習によってより多くの報酬をもたらす価値の高い行動となる。このような学習にともなう行動の価値の増加を反映するように、報酬をもたらす行動が遂行される前後で予想される報酬の好ましさに応じた活動の増大をみせるニューロンがみつかっている。

このような行動の価値を反映した神経活動は、線条体[7] [17][22] [23] [24] [25] [26]、後頭頂皮質[27]などで報告されている。

また、刺激や行動の価値を反映した神経活動には、期待される報酬の量や好ましさの情報とともに、報酬を予測する刺激の知覚情報、あるいは報酬を獲得するための行動にかかわる情報が符号化されている場合が多い[10] [8]。たとえば、サルの遅延反応課題中の神経活動を計測した実験では、手がかり刺激が視野の対側に呈示される試行でより大きな活動の高まりをみせるニューロンが線条体でみつかっている[15] [23] [26]。このような報酬および報酬獲得のための行動関連情報を含む報酬期待の神経信号は、報酬獲得のために適切な行動を遂行することを可能にしていると考えられる[10]。

報酬期待の神経活動

これまでの多くの実験から、動物の報酬への期待を反映するような神経活動が報告されている[2] [10] [9]。このような神経活動は、報酬を予測する刺激が呈示された後、報酬が獲得されるまでの間に持続的な増大をみせ、さらに活動の増大幅は予測された報酬の量や好ましさを反映するという特徴を持つ[2] [9](図2C)[8]。

報酬期待の神経活動がみられる脳領野は多岐にわたっている。大脳皮質下の領域では、線条体[28] [10] [29] [15] [30]、淡蒼球[31]、扁桃体 [32]、中脳ドーパミン領域(腹側被蓋野[33]・黒質網様部[34])、上丘[21]、脚橋被蓋核[35]などで報酬期待の神経活動がみられる。また、大脳皮質では、背外側前頭前皮質[6] [36] [37] [38]、眼窩前頭前皮質 [13] [32]、後頭頂皮質[39] [40]、前帯状回皮質[41]、島皮質[42] [43]、運動前野[14] [38]などで報酬期待の神経活動が報告されている。

報酬期待の神経活動は、刺激や行動の価値を反映した神経活動より時間的に遅れて高まる。このことは、報酬期待を反映した持続的な活動が、刺激や行動の価値を反映した神経活動によって引き起こされていることを示唆している[2]。刺激や行動の価値を表現した神経活動が、どのように報酬期待の神経活動を調節しているかについては、今後の研究が俟たれる。

ドーパミンニューロンの活動と報酬予測誤差

これまで報酬予測にかかわる学習の神経科学的研究は、ドーパミンニューロンのphasic活動が強化学習で一般に報酬予測誤差と呼ばれる学習信号を符号化しているとする「ドーパミン報酬予測誤差仮説」[44]に牽引されてきた。

ドーパミン報酬予測誤差仮説を支持する研究結果として、たとえば、サルのドーパミンニューロンの反応が学習に伴い変化することが知られている[44] [45]。ドーパミンニューロンは、学習の初期には報酬の獲得にあわせて活動を増大させる。この反応は学習が進むにつれ消失し、報酬を予測する手がかり刺激の呈示直後に活動が増大するようになる。また、予想された報酬が呈示されなかった場合には、報酬が予測された時刻の活動が低下する。これらのことは、ドーパミンニューロンが正負の報酬予測誤差を両方向的に符号化していることを示唆している[9]。さらに、阻止効果の実験でもドーパミンニューロンが強化学習の理論から予見される学習信号を反映した活動をみせることが報告されおり[46] [47]、近年ではオプトジェネティクスやマイクロスティミュレーションを用いてドーパミンニューロンの活動を人為的に操作すると学習が阻害されることが報告されている[48] 。

近年では、報酬予測誤差を反映するような神経活動が線条体[49]や内側前頭前皮質[50]などでも報告されており、また手綱外側核ではドーパミンニューロンとは逆に罰の予測に関連して負の報酬予測誤差を反映するニューロンが報告されている[51]。これらの神経活動もなんらかの形で報酬予測に関連する活動の調整に関与しているものと考えられるが、その詳細はまだわかっていない。さらに、報酬予測誤差そのものが脳でどのように計算されているのかという問題も今後の研究が俟たれている[2] [33] [26] [52] [53]。

ドーパミンニューロンは、前述の刺激や行動の価値を反映した神経活動が報告されている脳領域の多くに投射しており[10] [9]、ドーパミンニューロンの活動によってその投射先で起こるドーパミンの放出はシナプス強度を調節する[54] [55] [56]。これらのことは、報酬予測誤差を反映したドーパミン動物の活動が、神経可塑性を介して脳における価値表現を調節していることを示唆している。

関連項目

参考文献

- ↑ 1.0 1.1 Mark E Bouton

Learning and behavior: A contemporary synthesis Second Edition

Sinauer Associates: 2007 - ↑ 2.0 2.1 2.2 2.3 2.4 2.5 2.6 2.7 筒井健一郎、大山佳

報酬期待の神経科学、社会脳シリーズ第5巻・報酬を期待する脳

苧坂直行編、新曜社(東京):2014 - ↑ Peter Dayan, L. F. Abbott

Theoretical Neuroscience: Computational and Mathematical Modeling of Neural Systems

The MIT Press: 2001 - ↑ Peter Dayan, Hiroyuki Nakahara

Models and Methods for Reinforcement Learning, The Stevens’ Handbook of Experimental Psychology

Wiley: 2017 - ↑ O L Tinklepaugh

An experimental study of representative factors in monkeys.

J. Comp. Psychol.: 1928, (8);197-236 - ↑ 6.0 6.1

Watanabe, M. (1996).

Reward expectancy in primate prefrontal neurons. Nature, 382(6592), 629-32. [PubMed:8757133] [WorldCat] [DOI] - ↑ 7.0 7.1 7.2

Hassani, O.K., Cromwell, H.C., & Schultz, W. (2001).

Influence of expectation of different rewards on behavior-related neuronal activity in the striatum. Journal of neurophysiology, 85(6), 2477-89. [PubMed:11387394] [WorldCat] [DOI] - ↑ 8.0 8.1 8.2 8.3 8.4

Schultz, W. (2015).

Neuronal Reward and Decision Signals: From Theories to Data. Physiological reviews, 95(3), 853-951. [PubMed:26109341] [PMC] [WorldCat] [DOI] - ↑ 9.0 9.1 9.2 9.3 9.4 9.5

Schultz, W. (2006).

Behavioral theories and the neurophysiology of reward. Annual review of psychology, 57, 87-115. [PubMed:16318590] [WorldCat] [DOI] - ↑ 10.0 10.1 10.2 10.3 10.4 10.5 10.6

Hikosaka, O., Nakamura, K., & Nakahara, H. (2006).

Basal ganglia orient eyes to reward. Journal of neurophysiology, 95(2), 567-84. [PubMed:16424448] [WorldCat] [DOI] - ↑

Padoa-Schioppa, C., & Assad, J.A. (2006).

Neurons in the orbitofrontal cortex encode economic value. Nature, 441(7090), 223-6. [PubMed:16633341] [PMC] [WorldCat] [DOI] - ↑

Rolls, E.T., Critchley, H.D., Mason, R., & Wakeman, E.A. (1996).

Orbitofrontal cortex neurons: role in olfactory and visual association learning. Journal of neurophysiology, 75(5), 1970-81. [PubMed:8734596] [WorldCat] [DOI] - ↑ 13.0 13.1

Tremblay, L., & Schultz, W. (1999).

Relative reward preference in primate orbitofrontal cortex. Nature, 398(6729), 704-8. [PubMed:10227292] [WorldCat] [DOI] - ↑ 14.0 14.1

Roesch, M.R., & Olson, C.R. (2004).

Neuronal activity related to reward value and motivation in primate frontal cortex. Science (New York, N.Y.), 304(5668), 307-10. [PubMed:15073380] [WorldCat] [DOI] - ↑ 15.0 15.1 15.2

Kawagoe, R., Takikawa, Y., & Hikosaka, O. (1998).

Expectation of reward modulates cognitive signals in the basal ganglia. Nature neuroscience, 1(5), 411-6. [PubMed:10196532] [WorldCat] [DOI] - ↑

Kimura, M., Rajkowski, J., & Evarts, E. (1984).

Tonically discharging putamen neurons exhibit set-dependent responses. Proceedings of the National Academy of Sciences of the United States of America, 81(15), 4998-5001. [PubMed:6589643] [PMC] [WorldCat] [DOI] - ↑ 17.0 17.1

Cromwell, H.C., & Schultz, W. (2003).

Effects of expectations for different reward magnitudes on neuronal activity in primate striatum. Journal of neurophysiology, 89(5), 2823-38. [PubMed:12611937] [WorldCat] [DOI] - ↑

Nishijo, H., Ono, T., & Nishino, H. (1988).

Single neuron responses in amygdala of alert monkey during complex sensory stimulation with affective significance. The Journal of neuroscience : the official journal of the Society for Neuroscience, 8(10), 3570-83. [PubMed:3193171] [WorldCat] - ↑

Paton, J.J., Belova, M.A., Morrison, S.E., & Salzman, C.D. (2006).

The primate amygdala represents the positive and negative value of visual stimuli during learning. Nature, 439(7078), 865-70. [PubMed:16482160] [PMC] [WorldCat] [DOI] - ↑

Schultz, W. (1986).

Responses of midbrain dopamine neurons to behavioral trigger stimuli in the monkey. Journal of neurophysiology, 56(5), 1439-61. [PubMed:3794777] [WorldCat] [DOI] - ↑ 21.0 21.1

Ikeda, T., & Hikosaka, O. (2003).

Reward-dependent gain and bias of visual responses in primate superior colliculus. Neuron, 39(4), 693-700. [PubMed:12925282] [WorldCat] [DOI] - ↑

Samejima, K., Ueda, Y., Doya, K., & Kimura, M. (2005).

Representation of action-specific reward values in the striatum. Science (New York, N.Y.), 310(5752), 1337-40. [PubMed:16311337] [WorldCat] [DOI] - ↑ 23.0 23.1

Lauwereyns, J., Watanabe, K., Coe, B., & Hikosaka, O. (2002).

A neural correlate of response bias in monkey caudate nucleus. Nature, 418(6896), 413-7. [PubMed:12140557] [WorldCat] [DOI] - ↑

Watanabe, K., Lauwereyns, J., & Hikosaka, O. (2003).

Neural correlates of rewarded and unrewarded eye movements in the primate caudate nucleus. The Journal of neuroscience : the official journal of the Society for Neuroscience, 23(31), 10052-7. [PubMed:14602819] [PMC] [WorldCat] - ↑

Lau, B., & Glimcher, P.W. (2008).

Value representations in the primate striatum during matching behavior. Neuron, 58(3), 451-63. [PubMed:18466754] [PMC] [WorldCat] [DOI] - ↑ 26.0 26.1 26.2

Nakamura, K., Santos, G.S., Matsuzaki, R., & Nakahara, H. (2012).

Differential reward coding in the subdivisions of the primate caudate during an oculomotor task. The Journal of neuroscience : the official journal of the Society for Neuroscience, 32(45), 15963-82. [PubMed:23136434] [PMC] [WorldCat] [DOI] - ↑

Sugrue, L.P., Corrado, G.S., & Newsome, W.T. (2004).

Matching behavior and the representation of value in the parietal cortex. Science (New York, N.Y.), 304(5678), 1782-7. [PubMed:15205529] [WorldCat] [DOI] - ↑

Schultz, W., Apicella, P., Scarnati, E., & Ljungberg, T. (1992).

Neuronal activity in monkey ventral striatum related to the expectation of reward. The Journal of neuroscience : the official journal of the Society for Neuroscience, 12(12), 4595-610. [PubMed:1464759] [WorldCat] - ↑

Hikosaka, O., Sakamoto, M., & Usui, S. (1989).

Functional properties of monkey caudate neurons. III. Activities related to expectation of target and reward. Journal of neurophysiology, 61(4), 814-32. [PubMed:2723722] [WorldCat] [DOI] - ↑

Bowman, E.M., Aigner, T.G., & Richmond, B.J. (1996).

Neural signals in the monkey ventral striatum related to motivation for juice and cocaine rewards. Journal of neurophysiology, 75(3), 1061-73. [PubMed:8867118] [WorldCat] [DOI] - ↑

Tachibana, Y., & Hikosaka, O. (2012).

The primate ventral pallidum encodes expected reward value and regulates motor action. Neuron, 76(4), 826-37. [PubMed:23177966] [PMC] [WorldCat] [DOI] - ↑ 32.0 32.1

Schoenbaum, G., Chiba, A.A., & Gallagher, M. (1998).

Orbitofrontal cortex and basolateral amygdala encode expected outcomes during learning. Nature neuroscience, 1(2), 155-9. [PubMed:10195132] [WorldCat] [DOI] - ↑ 33.0 33.1

Cohen, J.Y., Haesler, S., Vong, L., Lowell, B.B., & Uchida, N. (2012).

Neuron-type-specific signals for reward and punishment in the ventral tegmental area. Nature, 482(7383), 85-8. [PubMed:22258508] [PMC] [WorldCat] [DOI] - ↑

Sato, M., & Hikosaka, O. (2002).

Role of primate substantia nigra pars reticulata in reward-oriented saccadic eye movement. The Journal of neuroscience : the official journal of the Society for Neuroscience, 22(6), 2363-73. [PubMed:11896175] [PMC] [WorldCat] - ↑

Okada, K., Toyama, K., Inoue, Y., Isa, T., & Kobayashi, Y. (2009).

Different pedunculopontine tegmental neurons signal predicted and actual task rewards. The Journal of neuroscience : the official journal of the Society for Neuroscience, 29(15), 4858-70. [PubMed:19369554] [PMC] [WorldCat] [DOI] - ↑

Inoue, M., Oomura, Y., Aou, S., Nishino, H., & Sikdar, S.K. (1985).

Reward related neuronal activity in monkey dorsolateral prefrontal cortex during feeding behavior. Brain research, 326(2), 307-12. [PubMed:3971157] [WorldCat] [DOI] - ↑

Leon, M.I., & Shadlen, M.N. (1999).

Effect of expected reward magnitude on the response of neurons in the dorsolateral prefrontal cortex of the macaque. Neuron, 24(2), 415-25. [PubMed:10571234] [WorldCat] [DOI] - ↑ 38.0 38.1

Roesch, M.R., & Olson, C.R. (2003).

Impact of expected reward on neuronal activity in prefrontal cortex, frontal and supplementary eye fields and premotor cortex. Journal of neurophysiology, 90(3), 1766-89. [PubMed:12801905] [WorldCat] [DOI] - ↑

Platt, M.L., & Glimcher, P.W. (1999).

Neural correlates of decision variables in parietal cortex. Nature, 400(6741), 233-8. [PubMed:10421364] [WorldCat] [DOI] - ↑

Sugrue, L.P., Corrado, G.S., & Newsome, W.T. (2004).

Matching behavior and the representation of value in the parietal cortex. Science (New York, N.Y.), 304(5678), 1782-7. [PubMed:15205529] [WorldCat] [DOI] - ↑

Shidara, M., & Richmond, B.J. (2002).

Anterior cingulate: single neuronal signals related to degree of reward expectancy. Science (New York, N.Y.), 296(5573), 1709-11. [PubMed:12040201] [WorldCat] [DOI] - ↑

Asahi, T., Uwano, T., Eifuku, S., Tamura, R., Endo, S., Ono, T., & Nishijo, H. (2006).

Neuronal responses to a delayed-response delayed-reward go/nogo task in the monkey posterior insular cortex. Neuroscience, 143(2), 627-39. [PubMed:16979828] [WorldCat] [DOI] - ↑

Mizuhiki, T., Richmond, B.J., & Shidara, M. (2012).

Encoding of reward expectation by monkey anterior insular neurons. Journal of neurophysiology, 107(11), 2996-3007. [PubMed:22402653] [PMC] [WorldCat] [DOI] - ↑ 44.0 44.1

Schultz, W., Dayan, P., & Montague, P.R. (1997).

A neural substrate of prediction and reward. Science (New York, N.Y.), 275(5306), 1593-9. [PubMed:9054347] [WorldCat] [DOI] - ↑

Mirenowicz, J., & Schultz, W. (1994).

Importance of unpredictability for reward responses in primate dopamine neurons. Journal of neurophysiology, 72(2), 1024-7. [PubMed:7983508] [WorldCat] [DOI] - ↑

Waelti, P., Dickinson, A., & Schultz, W. (2001).

Dopamine responses comply with basic assumptions of formal learning theory. Nature, 412(6842), 43-8. [PubMed:11452299] [WorldCat] [DOI] - ↑

Nakahara, H., Itoh, H., Kawagoe, R., Takikawa, Y., & Hikosaka, O. (2004).

Dopamine neurons can represent context-dependent prediction error. Neuron, 41(2), 269-80. [PubMed:14741107] [WorldCat] [DOI] - ↑

Schultz, W., Stauffer, W.R., & Lak, A. (2017).

The phasic dopamine signal maturing: from reward via behavioural activation to formal economic utility. Current opinion in neurobiology, 43, 139-148. [PubMed:28390863] [WorldCat] [DOI] - ↑

Oyama, K., Hernádi, I., Iijima, T., & Tsutsui, K. (2010).

Reward prediction error coding in dorsal striatal neurons. The Journal of neuroscience : the official journal of the Society for Neuroscience, 30(34), 11447-57. [PubMed:20739566] [PMC] [WorldCat] [DOI] - ↑

Matsumoto, M., Matsumoto, K., Abe, H., & Tanaka, K. (2007).

Medial prefrontal cell activity signaling prediction errors of action values. Nature neuroscience, 10(5), 647-56. [PubMed:17450137] [WorldCat] [DOI] - ↑

Matsumoto, M., & Hikosaka, O. (2007).

Lateral habenula as a source of negative reward signals in dopamine neurons. Nature, 447(7148), 1111-5. [PubMed:17522629] [WorldCat] [DOI] - ↑

Nakahara, H., & Hikosaka, O. (2012).

Learning to represent reward structure: a key to adapting to complex environments. Neuroscience research, 74(3-4), 177-83. [PubMed:23069349] [PMC] [WorldCat] [DOI] - ↑

Nakahara, H. (2014).

Multiplexing signals in reinforcement learning with internal models and dopamine. Current opinion in neurobiology, 25, 123-9. [PubMed:24463329] [WorldCat] [DOI] - ↑

Reynolds, J.N., Hyland, B.I., & Wickens, J.R. (2001).

A cellular mechanism of reward-related learning. Nature, 413(6851), 67-70. [PubMed:11544526] [WorldCat] [DOI] - ↑

Calabresi, P., Picconi, B., Tozzi, A., & Di Filippo, M. (2007).

Dopamine-mediated regulation of corticostriatal synaptic plasticity. Trends in neurosciences, 30(5), 211-9. [PubMed:17367873] [WorldCat] [DOI] - ↑

Yagishita, S., Hayashi-Takagi, A., Ellis-Davies, G.C., Urakubo, H., Ishii, S., & Kasai, H. (2014).

A critical time window for dopamine actions on the structural plasticity of dendritic spines. Science (New York, N.Y.), 345(6204), 1616-20. [PubMed:25258080] [PMC] [WorldCat] [DOI]

(執筆者:望月泰博、福田玄明、陳冲、中原裕之、担当編集委員:??)