「ドリフト拡散モデル」の版間の差分

Kentaro Katahira (トーク | 投稿記録) 細編集の要約なし |

|||

| (3人の利用者による、間の101版が非表示) | |||

| 1行目: | 1行目: | ||

<div align="right"> | <div align="right"> | ||

<font size="+1">[https://researchmap.jp/7000006268 片平 健太郎]</font><br> | <font size="+1">[https://researchmap.jp/7000006268 片平 健太郎]</font><br> | ||

'' | ''国立研究開発法人 産業技術総合研究所 人間情報インタラクション研究部門''<br> | ||

<font size="+1">[https://researchmap.jp/ykunisato 国里 愛彦]</font><br> | <font size="+1">[https://researchmap.jp/ykunisato 国里 愛彦]</font><br> | ||

'' | ''専修大学 人間科学部心理学科''<br> | ||

</div> | </div> | ||

英語名:drift diffusion model | |||

類義語:逐次サンプリングモデル ( | 類義語:逐次サンプリングモデル (Sequential sampling model) | ||

{{box|text= | {{box|text= | ||

ドリフト拡散モデルは,刺激呈示から反応が起こるまでの意思決定プロセスを説明する数理モデルの一つである。反応選択と反応時間の分布を説明するモデルとして,心理学や神経科学の研究において幅広く用いられている。その性質は確率過程に関する数学的理論や計算機シミュレーションにより詳細に調べられている。実際の反応データからモデルのパラメータを推定することも可能であり,パラメータの個人差や群間差を定量化することにも用いられている。また,モデルの振る舞いに類似する神経活動も観測されており,意思決定の神経基盤のモデルとしても注目されている。 | |||

}} | }} | ||

== | ==ドリフト拡散モデルの概要== | ||

[[Image:DDMの概要.png|thumb|320px|<b>図1.ドリフト拡散モデルにおける反応と反応時間の生成過程</b>]]<br> | |||

ドリフト拡散モデルは,刺激呈示から反応が起こるまでの経過時間(反応時間)と反応選択の分布を説明するモデルである。ドリフト拡散モデルは,Ratcliff (1978) | |||

<ref><b>Ratcliff, R.(1978).</b><br>A theory of memory retrieval.<br><i>Psychological Review</i> 1978, 85(2);59–108</ref>が提案し,心理学や神経科学における反応時間のモデリングにおいて,幅広く用いられている<ref><pubmed> 26952739 </pubmed></ref>。 | |||

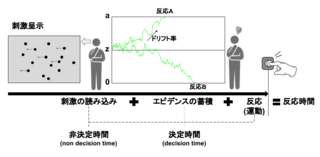

ドリフト拡散モデルは,逐次サンプリングモデル(Sequential sampling model)の一種である。逐次サンプリングモデルでは,刺激が呈示されると生体は時間経過とともに確率的に情報を蓄積していき,その蓄積が境界を越えた時に反応が出力されると仮定する。図1に示すように,行動課題を実施した際に,反応までにかかる時間は,(1)刺激の読み込み,(2)エビデンス(判断を下すのに必要な情報)の蓄積,(3)反応(ボタン押しなどの運動)に分解することができる。(1)刺激の読み込みと(3)反応は,判断に関わる過程ではないので,非決定時間(Non decision time)と呼ばれる。(2)エビデンスの蓄積は,決定時間(Decision time)と呼ばれる。ドリフト拡散モデルをはじめとする逐次サンプリングモデルを用いることで,非決定時間の推定と決定時間の生成に関わるパラメータの推定を行うことができる。 | |||

ドリフト拡散モデルにおけるエビデンスの蓄積過程は,開始点<math>z</math>から始まり,一定のドリフト率に従ってエビデンスが蓄積される(図1)。そして,境界の<math>a</math>もしくはその反対側の境界までエビデンスが蓄積されると反応が出力される。図1の場合,<math>a</math>に到達すると反応Aが出力され,0に到達すると反応Bが出力される。開始点と境界(a)との距離が遠いほど,エビデンスの蓄積にかかる時間が長くなる。また,開始点から境界までの蓄積過程における速度は,ドリフト率にも依存する。ドリフト率が大きいほど,境界まで到達する時間は短くなる。開始点,ドリフト率,境界,そして非決定時間がドリフト拡散モデルの主なパラメータである。 | |||

==モデルの定式化== | ==モデルの定式化== | ||

[[Image:DDM_animation.gif|thumb|320px|<b>図2.ドリフト拡散モデルのエビデンス蓄積過程と,反応時間分布。</b>ドリフト率や開始点,非決定時間は試行間で固定している。]]<br> | |||

ここでは,反応Aと反応Bのいずれかの反応が求められる強制二肢選択課題を想定し,基本的なドリフト拡散モデルを考える。上側の境界を<math>a</math>,下側の境界を0, 開始点を<math>z</math>とする。上側の境界に決定変数 (decision variable) <math>x</math>が到達した場合,そのタイミングで反応Aが起こり,下側の境界である0に到達したらそのタイミングで反応Bが起こると仮定する。刺激が呈示されてから,刺激情報の読み込みや反応の準備に必要な時間が経過してからエビデンスの蓄積が行われ,<math>x</math>が変化する。エビデンスの蓄積過程は以下の式のように連続時間上で定義される確率過程である,ウィーナー過程 (ブラウン運動) に従うとする。 | |||

<math>dx = v dt + \sigma dW</math> | |||

ここで,<math>dx</math> は微小な時間間隔 <math>dt</math>の間の<math>x</math>の変化を表す。<math>v</math>はドリフト率パラメータであり,<math>v > 0</math>であれば,反応Aが正解であり,<math>v < 0</math>であれば反応Bが正解であるとする。<math>\sigma dW</math>は平均が0で分散が<math>\sigma^2 dt</math>となる正規分布に従うホワイトノイズを表す。ウィーナー過程は連続時間上で定義されるが,計算機上でシミュレーションする場合は,離散時間で近似する必要がある。ここでは理解が容易なシンプルな近似法を考える。微小な時間幅<math>\Delta t</math>を考え,<math> \epsilon_i</math>が平均0, 分散1の標準正規分布に従うとする。この時間幅<math>\Delta t</math>あたりの変数<math>x</math>の変化量は,以下の式で記述される。 | |||

<math>\Delta x = v \Delta t + \sigma \epsilon_i \sqrt{\Delta t} </math> | |||

この式で<math>x</math> | この式で<math>x</math>を更新していくことによりエビデンスの蓄積過程をシミュレートできる。図2はこの計算により得られたものである。 | ||

生体が注意深く反応するほどパラメータ<math>a</math>は大きくなり,境界の間は広がると考えられる。逆に,素早く反応することが求められる場合は<math>a</math>は小さくなる。開始点パラメータ<math>z</math>は刺激に関する事前の期待を表すと考えられる。例えば,反応Aを起こすべき刺激が期待されるときは,このパラメータは大きい (<math>a</math>に近い) 値をとる。 | |||

標準的なドリフト拡散モデル (Ratcliff, 1978) では,開始点とドリフト率,および非決定時間は,試行間で変動すると仮定される。ドリフト率の試行間変動は,刺激に対する注意の変化などに対応すると考えられ,正規分布に従って変動するとされる。この変動を仮定することで,正反応より誤反応の方が反応時間が長くなるということが説明可能となる。これは,ドリフト率が小さくなる試行において,誤反応が起こりやすくなり,かつ反応時間が長くなるためである。開始点の試行間変動は一様分布に従うと仮定され,ある特定の刺激がどの程度呈示されやすいかについての期待が試行間で変動することを表現する。この変動により,誤反応が起こる試行で反応時間が短くなることが説明できる。なぜなら,開始点が誤反応側の境界に寄っているときに,反応が早くなり,かつ誤反応が起きやすいためである。 | |||

以上のように,標準的なドリフト拡散モデルのパラメータは,開始点(z),開始点の試行間変動幅 (<math>s_{z}</math>),ドリフト率の平均(<math>m_v</math>),ドリフト率の標準偏差(<math>\eta</math>), 境界(<math>a</math>),非決定時間の平均(<math>T_{er}</math>),非決定時間の試行間変動(<math>s_{t}</math>)の7つとなる。 | |||

== | ==反応時間分布および選択確率とモデルパラメータの関係== | ||

二つの選択に関する上記のモデルにおいて,各パラメータを固定した場合 (試行間変動は仮定しない場合),それぞれの選択肢を選ぶ確率,およびその反応時間の分布は次のように解析的に導出される (Ratcliff, 1978)。下側の境界 (0) に到達し,反応Bが起こる確率は, | |||

<math>\frac{e^{-2va/\sigma^2}-e^{-2vz/\sigma^2}}{e^{-2va/\sigma^2}-1}</math> | |||

となる。ただしドリフト率<math>v</math>が0だった場合はこの確率は | |||

<math>1-z/a</math> | |||

となる。さらに,反応Bが起こり,かつその反応時間が<math>T_{er}+t </math>となる条件付きの確率密度関数は | |||

<math>\frac{\pi \sigma^2}{a^2} e^{-zv/\sigma^2} \sum_{k=1}^\infty k \sin (\frac{\pi z k}{a}) e^{-\frac{1}{2} (v^2 / \sigma^2 + \pi^2 k^2 \sigma^2/a^2)t} </math> | |||

で与えられる。境界<math>a</math>に到達し反応Aが起こり,その反応時間が<math> T_{er} + t</math>となる確率密度は,上の式において<math>v</math>を<math>-v</math>で, <math>z</math> を<math>a -z</math>で置き換えることで得られる。図Xの上下の曲線はこれらの式により得られた条件付きの確率密度関数である。シミュレーションにより得た反応時間のヒストグラムもサンプルが増えるにつれてこの関数に近づいていくことがわかる 。 | |||

で与えられる。境界<math>a</math> | |||

==モデルフィッティング== | ==モデルフィッティング== | ||

上記のように解析的に得られる反応時間の分布が実際のデータに近づくようにパラメータを調整することで,明示的にドリフト拡散過程をシミュレートせずともモデルのパラメータを推定することができる。また,複数ある候補のモデルからデータをよりよく説明するモデルを選択することも可能となる。パラメータの推定やモデル選択をする作業を総称してモデルフィッティングと呼ぶ。 | |||

実験で収集された反応データに対して,モデルフィッティングをする方法として,<math>\chi^{2}</math>最小化,最尤法,重み付き最小二乗法,ベイズ推定等がある<ref><pubmed> 12412886</pubmed></ref>。モデルフィッティング用のソフトウェアとしては,以下がある。 | |||

* Fast-dm: Voss & Voss (2007)が開発したWindowsで動作するソフト(最尤推定,Kolmogorov-Smirnov,<math>\chi^{2}</math>最小化などの方法が可能) | |||

* DMAT: Vandekerckhove & Tuerlinckx (2008)が開発した,ドリフト拡散モデル用MATLABツールボックス。 | |||

* EZ2: Wagenmakers, Van Der Maas, & Grasman(2007)によって提案されたドリフト拡散モデルから施行間変動の推定を除いたシンプルなEZ拡散モデルを用いてモデルフィッティングするRパッケージ | |||

* HDDM: Wiecki, Sofer, & Frank(2013)が開発した,ドリフト拡散モデルを階層ベイズ推定するPythonパッケージ | |||

* hBayesDM: Ahn, Haines, & Zhang(2017)が開発した,意思決定課題に対して階層ベイズモデリングを行うRパッケージ。ドリフト拡散モデルを使ったモデルフィッティングができる関数が含まれている。 | |||

* rtdists: ドリフト拡散モデルをはじめとする反応時間のモデリングに有用な関数が含められたRパッケージ。 | |||

それぞれのモデルや推定方法には仮定がおかれていることがあり,モデルフィッティングに用いるデータがその仮定に合っているかどうかは事前に確認する必要がある。各種推定法に関する専門家による推奨については,Boehm et al.(2018)にまとめられている。また,ドリフト拡散モデルでのモデルフィッティングにあたっては,十分なデータ数が必要になる。特に反応時間の分布の情報を用いてパラメータ推定する方法の場合は,試行数が100程度の場合は,ドリフト拡散モデルの試行間変動性にかかわるパラメータの推定が真値からずれることが示されている(Vandekerckhove, & Tuerlinckx, 2007)。そのため,試行間変動性にかかわるパラメータの推定を行う場合は,できるだけ多くの試行数が必要になるが,試行数を増やすと参加者の動機づけが低下する,疲れの影響が出る,などの問題も生じる。また,そもそも試行数を増やすことが難しい実験状況も多い(Boehm et al., 2018)。そこで,パラメータ推定にあたり,参加者集団のパタメータの分布も仮定した階層ベイズ推定を行うことで,各参加者の試行数は少なくとも安定した推定する方法も提案されている(Wiecki, Sofer, & Frank, 2013; Ahn, Haines, & Zhang, 2017)。 | |||

==適用事例== | ==適用事例== | ||

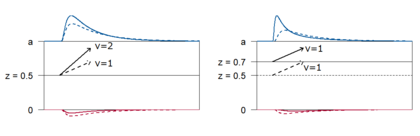

[[Image:DDM_z_vs_v.png|thumb|420px|<b>図3.反応時間分布に及ぼすドリフト率 (左) 開始点パラメータ (右) の影響。</b>破線は参照となるベースのモデル (<math>v = 1.0, z = 0.5 </math>) を表す。実線はパラメータを変化させたときの結果を表し,左のパネルはドリフト率を大きくした場合 (<math>v = 2.0 </math>) ,右のパネルは開始点を高くした場合 (<math>z = 0.7 </math>) である。]]<br> | |||

ドリフト拡散モデルを用いることで,反応分布の形状の情報を利用することが可能となり,単純な平均反応時間の解析では取りこぼされていた情報を利用して詳細なプロセスを検討することができる。例えば,開始点パラメータ<math>z</math>を増加させることと,ドリフト率<math>v</math>を増加させることはいずれも反応Aの選択確率を増加させ,その平均的な反応時間を短くする効果があるが,その反応時間分布の形状に与える影響が異なる。図Xの左では,開始点パラメータ<math>z</math>を固定し,ドリフト率を増加させた場合である (実線が増加後)。この場合,反応Aの確率が高くなり,速い反応時間の密度が増加するため平均反応時間は短くなるが,その分布のピーク (最も密度が高くなる地点) はほとんど変化しない。一方,開始点パラメータ<math>z</math>を<math>a</math>に近づけた場合 (図X右図) は,分布の形状が大きく変わり,反応Aの反応時間分布のピークが速い時間帯にシフトし,分布の歪みが大きくなる。 | |||

ヒトやその他の動物の意思決定には,現在の感覚入力や過去の選択の結果のみならず,過去の選択履歴が次の選択に影響することがよく知られている (Akaishi et al.)。同じ選択を繰り返す傾向は選択の慣性 (inertia) や固執性 (perseverance) と呼ばれている。そのような傾向はドリフト拡散モデルではエビデンスの蓄積の開始点にバイアスを与えるという解釈が可能である。しかし,実際の知覚的意思決定課題における選択データにおいては,過去の選択と同じ選択が選ばれる効果は,図X左のように比較的反応が遅い場合でも見られ,そのようなデータは開始点よりはむしろドリフト率が過去と同じ選択をする方向にバイアスがかかるとするモデルでよく説明されることが報告されている (Urai et al.)。この結果は,選択履歴の効果が,知覚的なエビデンスの蓄積過程に影響するということを明らかにしている。 | |||

ドリフト拡散モデルのパラメータの推定値を利用して,選択に関するプロセスの個人差に影響する要因も検討されている。代表的な事例は加齢の効果であり,例えば高齢者は一般に多くの認知課題において反応が遅くなることが示されているが,ドリフト拡散モデルを適用して検討した研究では,高齢者は長い非決定時間,そして境界の間隔が大きいという特徴はあるものの,ドリフト率は若年者と比べても小さくはないということが報告されている (Ratcliff, Thapar , and McKoon, 2010)。 | |||

一方で,幼児では境界分離が大きく,非決定時間が長いことに加え,ドリフト率も比較的小さいことが示されている (Ratcliff, Love, Thompson, and Opfer, 2012)。また,注意欠如・多動症 (ADHD) や読字障害 (dyslexic) を有する若年者はそうでない統制群に比べ,ドリフト率が低い傾向があることを示した研究もある (Mulder et al.,2010, Zeguers et al., 2011) | |||

一般知能 (IQ) との関係に関しては,高IQ群は低IQ群よりドリフト率が2倍程度高いという報告もある (Ratcliff et al., 2010; Ratcliff et al., 2011)。一方で,加齢による影響が見られた,境界分離や非決定時間にはIQとの関連は見られなかった。 | |||

==神経細胞の活動との対応== | |||

主にサルを対象とした単一細胞レベルでの神経活動記録により,エビデンスの蓄積過程に対応する神経活動が検討されてきた。例えば視線でターゲットを選択することで反応する意思決定課題においては,ターゲットの方向へのサッケード時に選択的に活動するLIP野 (lateral intraparietal cortex) の細胞は刺激の呈示とともに徐々に活動が増加し,ある閾値に到達したときにサッケード反応が起こるということが観測されている (Shadlen and Newsome, 1996),エビデンスの蓄積を表現する逐次サンプリングモデルで様子が観察されている。 | |||

==その他の逐次サンプリングモデル== | ==その他の逐次サンプリングモデル== | ||

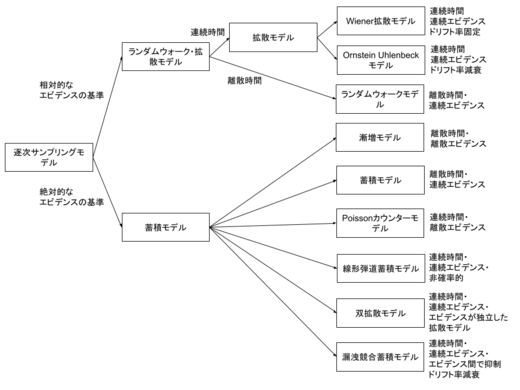

[[Image:逐次サンプリングモデルの図.png|thumb|520px|<b> | [[Image:逐次サンプリングモデルの図.png|thumb|520px|<b>図4.逐次サンプリングモデルの種類</b>(Ratcliff et al.,2016を元に一部改変)]]<br> | ||

逐次サンプリングモデルは,ドリフト拡散モデルだけではない。図**に示すように,逐次サンプリングモデルは,エビデンスの蓄積に関する基準が絶対的か相対的か,対象とする時間が連続的か離散的か,蓄積するエビデンスが連続的か離散的か,ドリフト率が固定か変化するかなどによって分類することができる。ドリフト拡散モデルは,逐次サンプリングモデルの代表的なモデルであるが,モデルの設定においては複数あるモデルの1つの形式であると言える(代表的な逐次サンプリングモデルのモデル間の差異については,Ratcliff & Smith(2004)を参照)。 | |||

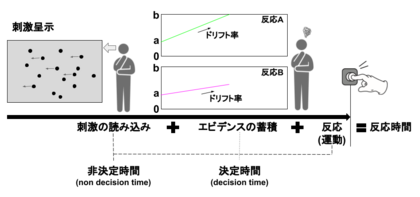

[[Image:LBAの概要.png|thumb|420px|<b>図5.線形弾道蓄積モデルにおける反応と反応時間の生成過程</b>]]<br> | |||

ドリフト拡散モデル以外の代表的な逐次サンプリングモデルとして,線形弾道蓄積モデル(Brown & Heathcote, 2008)がある。図5にあるように,線形弾道蓄積モデルは,ドリフト拡散モデルと類似しているが,エビデンスの蓄積の基準が絶対的なことと確率的ではない点が異なる。ドリフト拡散モデルでは,反応はエビデンス蓄積が上の境界と下の境界のどちらに到達するかで決まる相対的なものであった。一方,線形弾道蓄積モデルでは,それぞれの反応は独立してエビデンスの蓄積を行って,最終的に先に閾値(b)に到達した反応が出力される(図5の場合,先にbに到達した反応Aが出力される)。エビデンスの蓄積が始まる点を開始点(a)と呼び,選択肢で同一のこともあるが,異なることもある。開始点の位置の違いは,エビデンスの蓄積の前に存在する選択肢に対するバイアスとして解釈される。ドリフト拡散モデルと同様にエビデンスの蓄積の速さはドリフト率(d)が決めるが,蓄積過程は線形かつ非確率的である。各試行のドリフト率(d)は,平均v,標準偏差sの正規分布に従い,各試行の開始点(a)は,0からA(開始点の上限)の一様分布に従う。決定時間は,(b-a)/dで求めることができ,非決定時間(τ)は,全試行で一定とする。aとdは,推定するパラメータではなく,v, b, A, s, τ が推定するパラメータになる。線形弾道蓄積モデルは,ドリフト拡散モデルよりも推定するパラメータが少なく,2選択肢以外の状況にも適用できるので,ドリフト拡散モデルと合わせて今後の活用が期待できる。 | |||

==強化学習モデルとの統合== | ==モデルの拡張 (強化学習モデルとの統合)== | ||

ドリフト拡散モデルは,個々の試行内で刺激呈示から反応出力 (選択) までのプロセスを表現するモデルであるが,試行間の選択の変化を表す他の数理モデルと組み合わせることもできる。例えば,報酬に基づく学習のプロセスを表現する代表的なモデルである強化学習モデルとドリフト拡散モデルを組み合わせたモデルが提案されている<ref><pubmed>27966103</pubmed></ref><ref><pubmed>25589744</pubmed></ref>。一般の強化学習モデルでは,行動の結果与えられる報酬に基づいて各行動の価値を計算され,価値の高い行動が高い確率で選択される。この行動価値をドリフト拡散モデルのドリフト率に用いることで,選択肢の価値の差が小さいほど反応が競合し,反応時間が長くなるという仮定を置くことができる。そのように強化学習モデルを用いることでドリフト拡散モデルによる反応時間や選択の予測が改善できる。また,逆に反応時間をドリフト拡散モデルでモデル化することで,強化学習のパラメータの信頼性の改善も期待できる<ref><pubmed>30759077</pubmed></ref>。このように選択傾向の変化と反応時間を同時にモデル化して行動の背後にあるプロセスを探るというアプローチは,実験的に観測される情報をフルに活用できる枠組みとして今後の発展が期待される。 | |||

==参考文献== | ==参考文献== | ||

<references /> | <references /> | ||

2021年6月25日 (金) 18:41時点における版

英語名:drift diffusion model

類義語:逐次サンプリングモデル (Sequential sampling model)

ドリフト拡散モデルは,刺激呈示から反応が起こるまでの意思決定プロセスを説明する数理モデルの一つである。反応選択と反応時間の分布を説明するモデルとして,心理学や神経科学の研究において幅広く用いられている。その性質は確率過程に関する数学的理論や計算機シミュレーションにより詳細に調べられている。実際の反応データからモデルのパラメータを推定することも可能であり,パラメータの個人差や群間差を定量化することにも用いられている。また,モデルの振る舞いに類似する神経活動も観測されており,意思決定の神経基盤のモデルとしても注目されている。

ドリフト拡散モデルの概要

ドリフト拡散モデルは,刺激呈示から反応が起こるまでの経過時間(反応時間)と反応選択の分布を説明するモデルである。ドリフト拡散モデルは,Ratcliff (1978) [1]が提案し,心理学や神経科学における反応時間のモデリングにおいて,幅広く用いられている[2]。

ドリフト拡散モデルは,逐次サンプリングモデル(Sequential sampling model)の一種である。逐次サンプリングモデルでは,刺激が呈示されると生体は時間経過とともに確率的に情報を蓄積していき,その蓄積が境界を越えた時に反応が出力されると仮定する。図1に示すように,行動課題を実施した際に,反応までにかかる時間は,(1)刺激の読み込み,(2)エビデンス(判断を下すのに必要な情報)の蓄積,(3)反応(ボタン押しなどの運動)に分解することができる。(1)刺激の読み込みと(3)反応は,判断に関わる過程ではないので,非決定時間(Non decision time)と呼ばれる。(2)エビデンスの蓄積は,決定時間(Decision time)と呼ばれる。ドリフト拡散モデルをはじめとする逐次サンプリングモデルを用いることで,非決定時間の推定と決定時間の生成に関わるパラメータの推定を行うことができる。

ドリフト拡散モデルにおけるエビデンスの蓄積過程は,開始点から始まり,一定のドリフト率に従ってエビデンスが蓄積される(図1)。そして,境界のもしくはその反対側の境界までエビデンスが蓄積されると反応が出力される。図1の場合,に到達すると反応Aが出力され,0に到達すると反応Bが出力される。開始点と境界(a)との距離が遠いほど,エビデンスの蓄積にかかる時間が長くなる。また,開始点から境界までの蓄積過程における速度は,ドリフト率にも依存する。ドリフト率が大きいほど,境界まで到達する時間は短くなる。開始点,ドリフト率,境界,そして非決定時間がドリフト拡散モデルの主なパラメータである。

モデルの定式化

ここでは,反応Aと反応Bのいずれかの反応が求められる強制二肢選択課題を想定し,基本的なドリフト拡散モデルを考える。上側の境界を,下側の境界を0, 開始点をとする。上側の境界に決定変数 (decision variable) が到達した場合,そのタイミングで反応Aが起こり,下側の境界である0に到達したらそのタイミングで反応Bが起こると仮定する。刺激が呈示されてから,刺激情報の読み込みや反応の準備に必要な時間が経過してからエビデンスの蓄積が行われ,が変化する。エビデンスの蓄積過程は以下の式のように連続時間上で定義される確率過程である,ウィーナー過程 (ブラウン運動) に従うとする。

ここで, は微小な時間間隔 の間のの変化を表す。はドリフト率パラメータであり,であれば,反応Aが正解であり,であれば反応Bが正解であるとする。は平均が0で分散がとなる正規分布に従うホワイトノイズを表す。ウィーナー過程は連続時間上で定義されるが,計算機上でシミュレーションする場合は,離散時間で近似する必要がある。ここでは理解が容易なシンプルな近似法を考える。微小な時間幅を考え,が平均0, 分散1の標準正規分布に従うとする。この時間幅あたりの変数の変化量は,以下の式で記述される。

この式でを更新していくことによりエビデンスの蓄積過程をシミュレートできる。図2はこの計算により得られたものである。

生体が注意深く反応するほどパラメータは大きくなり,境界の間は広がると考えられる。逆に,素早く反応することが求められる場合はは小さくなる。開始点パラメータは刺激に関する事前の期待を表すと考えられる。例えば,反応Aを起こすべき刺激が期待されるときは,このパラメータは大きい (に近い) 値をとる。

標準的なドリフト拡散モデル (Ratcliff, 1978) では,開始点とドリフト率,および非決定時間は,試行間で変動すると仮定される。ドリフト率の試行間変動は,刺激に対する注意の変化などに対応すると考えられ,正規分布に従って変動するとされる。この変動を仮定することで,正反応より誤反応の方が反応時間が長くなるということが説明可能となる。これは,ドリフト率が小さくなる試行において,誤反応が起こりやすくなり,かつ反応時間が長くなるためである。開始点の試行間変動は一様分布に従うと仮定され,ある特定の刺激がどの程度呈示されやすいかについての期待が試行間で変動することを表現する。この変動により,誤反応が起こる試行で反応時間が短くなることが説明できる。なぜなら,開始点が誤反応側の境界に寄っているときに,反応が早くなり,かつ誤反応が起きやすいためである。

以上のように,標準的なドリフト拡散モデルのパラメータは,開始点(z),開始点の試行間変動幅 (),ドリフト率の平均(),ドリフト率の標準偏差(), 境界(),非決定時間の平均(),非決定時間の試行間変動()の7つとなる。

反応時間分布および選択確率とモデルパラメータの関係

二つの選択に関する上記のモデルにおいて,各パラメータを固定した場合 (試行間変動は仮定しない場合),それぞれの選択肢を選ぶ確率,およびその反応時間の分布は次のように解析的に導出される (Ratcliff, 1978)。下側の境界 (0) に到達し,反応Bが起こる確率は,

となる。ただしドリフト率が0だった場合はこの確率は となる。さらに,反応Bが起こり,かつその反応時間がとなる条件付きの確率密度関数は

で与えられる。境界に到達し反応Aが起こり,その反応時間がとなる確率密度は,上の式においてをで, をで置き換えることで得られる。図Xの上下の曲線はこれらの式により得られた条件付きの確率密度関数である。シミュレーションにより得た反応時間のヒストグラムもサンプルが増えるにつれてこの関数に近づいていくことがわかる 。

モデルフィッティング

上記のように解析的に得られる反応時間の分布が実際のデータに近づくようにパラメータを調整することで,明示的にドリフト拡散過程をシミュレートせずともモデルのパラメータを推定することができる。また,複数ある候補のモデルからデータをよりよく説明するモデルを選択することも可能となる。パラメータの推定やモデル選択をする作業を総称してモデルフィッティングと呼ぶ。

実験で収集された反応データに対して,モデルフィッティングをする方法として,最小化,最尤法,重み付き最小二乗法,ベイズ推定等がある[3]。モデルフィッティング用のソフトウェアとしては,以下がある。

- Fast-dm: Voss & Voss (2007)が開発したWindowsで動作するソフト(最尤推定,Kolmogorov-Smirnov,最小化などの方法が可能)

- DMAT: Vandekerckhove & Tuerlinckx (2008)が開発した,ドリフト拡散モデル用MATLABツールボックス。

- EZ2: Wagenmakers, Van Der Maas, & Grasman(2007)によって提案されたドリフト拡散モデルから施行間変動の推定を除いたシンプルなEZ拡散モデルを用いてモデルフィッティングするRパッケージ

- HDDM: Wiecki, Sofer, & Frank(2013)が開発した,ドリフト拡散モデルを階層ベイズ推定するPythonパッケージ

- hBayesDM: Ahn, Haines, & Zhang(2017)が開発した,意思決定課題に対して階層ベイズモデリングを行うRパッケージ。ドリフト拡散モデルを使ったモデルフィッティングができる関数が含まれている。

- rtdists: ドリフト拡散モデルをはじめとする反応時間のモデリングに有用な関数が含められたRパッケージ。

それぞれのモデルや推定方法には仮定がおかれていることがあり,モデルフィッティングに用いるデータがその仮定に合っているかどうかは事前に確認する必要がある。各種推定法に関する専門家による推奨については,Boehm et al.(2018)にまとめられている。また,ドリフト拡散モデルでのモデルフィッティングにあたっては,十分なデータ数が必要になる。特に反応時間の分布の情報を用いてパラメータ推定する方法の場合は,試行数が100程度の場合は,ドリフト拡散モデルの試行間変動性にかかわるパラメータの推定が真値からずれることが示されている(Vandekerckhove, & Tuerlinckx, 2007)。そのため,試行間変動性にかかわるパラメータの推定を行う場合は,できるだけ多くの試行数が必要になるが,試行数を増やすと参加者の動機づけが低下する,疲れの影響が出る,などの問題も生じる。また,そもそも試行数を増やすことが難しい実験状況も多い(Boehm et al., 2018)。そこで,パラメータ推定にあたり,参加者集団のパタメータの分布も仮定した階層ベイズ推定を行うことで,各参加者の試行数は少なくとも安定した推定する方法も提案されている(Wiecki, Sofer, & Frank, 2013; Ahn, Haines, & Zhang, 2017)。

適用事例

ドリフト拡散モデルを用いることで,反応分布の形状の情報を利用することが可能となり,単純な平均反応時間の解析では取りこぼされていた情報を利用して詳細なプロセスを検討することができる。例えば,開始点パラメータを増加させることと,ドリフト率を増加させることはいずれも反応Aの選択確率を増加させ,その平均的な反応時間を短くする効果があるが,その反応時間分布の形状に与える影響が異なる。図Xの左では,開始点パラメータを固定し,ドリフト率を増加させた場合である (実線が増加後)。この場合,反応Aの確率が高くなり,速い反応時間の密度が増加するため平均反応時間は短くなるが,その分布のピーク (最も密度が高くなる地点) はほとんど変化しない。一方,開始点パラメータをに近づけた場合 (図X右図) は,分布の形状が大きく変わり,反応Aの反応時間分布のピークが速い時間帯にシフトし,分布の歪みが大きくなる。

ヒトやその他の動物の意思決定には,現在の感覚入力や過去の選択の結果のみならず,過去の選択履歴が次の選択に影響することがよく知られている (Akaishi et al.)。同じ選択を繰り返す傾向は選択の慣性 (inertia) や固執性 (perseverance) と呼ばれている。そのような傾向はドリフト拡散モデルではエビデンスの蓄積の開始点にバイアスを与えるという解釈が可能である。しかし,実際の知覚的意思決定課題における選択データにおいては,過去の選択と同じ選択が選ばれる効果は,図X左のように比較的反応が遅い場合でも見られ,そのようなデータは開始点よりはむしろドリフト率が過去と同じ選択をする方向にバイアスがかかるとするモデルでよく説明されることが報告されている (Urai et al.)。この結果は,選択履歴の効果が,知覚的なエビデンスの蓄積過程に影響するということを明らかにしている。

ドリフト拡散モデルのパラメータの推定値を利用して,選択に関するプロセスの個人差に影響する要因も検討されている。代表的な事例は加齢の効果であり,例えば高齢者は一般に多くの認知課題において反応が遅くなることが示されているが,ドリフト拡散モデルを適用して検討した研究では,高齢者は長い非決定時間,そして境界の間隔が大きいという特徴はあるものの,ドリフト率は若年者と比べても小さくはないということが報告されている (Ratcliff, Thapar , and McKoon, 2010)。

一方で,幼児では境界分離が大きく,非決定時間が長いことに加え,ドリフト率も比較的小さいことが示されている (Ratcliff, Love, Thompson, and Opfer, 2012)。また,注意欠如・多動症 (ADHD) や読字障害 (dyslexic) を有する若年者はそうでない統制群に比べ,ドリフト率が低い傾向があることを示した研究もある (Mulder et al.,2010, Zeguers et al., 2011) 一般知能 (IQ) との関係に関しては,高IQ群は低IQ群よりドリフト率が2倍程度高いという報告もある (Ratcliff et al., 2010; Ratcliff et al., 2011)。一方で,加齢による影響が見られた,境界分離や非決定時間にはIQとの関連は見られなかった。

神経細胞の活動との対応

主にサルを対象とした単一細胞レベルでの神経活動記録により,エビデンスの蓄積過程に対応する神経活動が検討されてきた。例えば視線でターゲットを選択することで反応する意思決定課題においては,ターゲットの方向へのサッケード時に選択的に活動するLIP野 (lateral intraparietal cortex) の細胞は刺激の呈示とともに徐々に活動が増加し,ある閾値に到達したときにサッケード反応が起こるということが観測されている (Shadlen and Newsome, 1996),エビデンスの蓄積を表現する逐次サンプリングモデルで様子が観察されている。

その他の逐次サンプリングモデル

逐次サンプリングモデルは,ドリフト拡散モデルだけではない。図**に示すように,逐次サンプリングモデルは,エビデンスの蓄積に関する基準が絶対的か相対的か,対象とする時間が連続的か離散的か,蓄積するエビデンスが連続的か離散的か,ドリフト率が固定か変化するかなどによって分類することができる。ドリフト拡散モデルは,逐次サンプリングモデルの代表的なモデルであるが,モデルの設定においては複数あるモデルの1つの形式であると言える(代表的な逐次サンプリングモデルのモデル間の差異については,Ratcliff & Smith(2004)を参照)。

ドリフト拡散モデル以外の代表的な逐次サンプリングモデルとして,線形弾道蓄積モデル(Brown & Heathcote, 2008)がある。図5にあるように,線形弾道蓄積モデルは,ドリフト拡散モデルと類似しているが,エビデンスの蓄積の基準が絶対的なことと確率的ではない点が異なる。ドリフト拡散モデルでは,反応はエビデンス蓄積が上の境界と下の境界のどちらに到達するかで決まる相対的なものであった。一方,線形弾道蓄積モデルでは,それぞれの反応は独立してエビデンスの蓄積を行って,最終的に先に閾値(b)に到達した反応が出力される(図5の場合,先にbに到達した反応Aが出力される)。エビデンスの蓄積が始まる点を開始点(a)と呼び,選択肢で同一のこともあるが,異なることもある。開始点の位置の違いは,エビデンスの蓄積の前に存在する選択肢に対するバイアスとして解釈される。ドリフト拡散モデルと同様にエビデンスの蓄積の速さはドリフト率(d)が決めるが,蓄積過程は線形かつ非確率的である。各試行のドリフト率(d)は,平均v,標準偏差sの正規分布に従い,各試行の開始点(a)は,0からA(開始点の上限)の一様分布に従う。決定時間は,(b-a)/dで求めることができ,非決定時間(τ)は,全試行で一定とする。aとdは,推定するパラメータではなく,v, b, A, s, τ が推定するパラメータになる。線形弾道蓄積モデルは,ドリフト拡散モデルよりも推定するパラメータが少なく,2選択肢以外の状況にも適用できるので,ドリフト拡散モデルと合わせて今後の活用が期待できる。

モデルの拡張 (強化学習モデルとの統合)

ドリフト拡散モデルは,個々の試行内で刺激呈示から反応出力 (選択) までのプロセスを表現するモデルであるが,試行間の選択の変化を表す他の数理モデルと組み合わせることもできる。例えば,報酬に基づく学習のプロセスを表現する代表的なモデルである強化学習モデルとドリフト拡散モデルを組み合わせたモデルが提案されている[4][5]。一般の強化学習モデルでは,行動の結果与えられる報酬に基づいて各行動の価値を計算され,価値の高い行動が高い確率で選択される。この行動価値をドリフト拡散モデルのドリフト率に用いることで,選択肢の価値の差が小さいほど反応が競合し,反応時間が長くなるという仮定を置くことができる。そのように強化学習モデルを用いることでドリフト拡散モデルによる反応時間や選択の予測が改善できる。また,逆に反応時間をドリフト拡散モデルでモデル化することで,強化学習のパラメータの信頼性の改善も期待できる[6]。このように選択傾向の変化と反応時間を同時にモデル化して行動の背後にあるプロセスを探るというアプローチは,実験的に観測される情報をフルに活用できる枠組みとして今後の発展が期待される。

参考文献

- ↑ Ratcliff, R.(1978).

A theory of memory retrieval.

Psychological Review 1978, 85(2);59–108 - ↑

Ratcliff, R., Smith, P.L., Brown, S.D., & McKoon, G. (2016).

Diffusion Decision Model: Current Issues and History. Trends in cognitive sciences, 20(4), 260-281. [PubMed:26952739] [PMC] [WorldCat] [DOI] - ↑

Ratcliff, R., & Tuerlinckx, F. (2002).

Estimating parameters of the diffusion model: approaches to dealing with contaminant reaction times and parameter variability. Psychonomic bulletin & review, 9(3), 438-81. [PubMed:12412886] [PMC] [WorldCat] [DOI] - ↑

Pedersen, M.L., Frank, M.J., & Biele, G. (2017).

The drift diffusion model as the choice rule in reinforcement learning. Psychonomic bulletin & review, 24(4), 1234-1251. [PubMed:27966103] [PMC] [WorldCat] [DOI] - ↑

Frank, M.J., Gagne, C., Nyhus, E., Masters, S., Wiecki, T.V., Cavanagh, J.F., & Badre, D. (2015).

fMRI and EEG predictors of dynamic decision parameters during human reinforcement learning. The Journal of neuroscience : the official journal of the Society for Neuroscience, 35(2), 485-94. [PubMed:25589744] [PMC] [WorldCat] [DOI] - ↑

Shahar, N., Hauser, T.U., Moutoussis, M., Moran, R., Keramati, M., NSPN consortium, & Dolan, R.J. (2019).

Improving the reliability of model-based decision-making estimates in the two-stage decision task with reaction-times and drift-diffusion modeling. PLoS computational biology, 15(2), e1006803. [PubMed:30759077] [PMC] [WorldCat] [DOI]