「模倣学習」の版間の差分

| (同じ利用者による、間の2版が非表示) | |||

| 59行目: | 59行目: | ||

#観察した行動から模倣行動をどのようにマップするか?(対応付け問題) | #観察した行動から模倣行動をどのようにマップするか?(対応付け問題) | ||

#模倣の試みの成否をどのように評価するか?(成功の度合い) | #模倣の試みの成否をどのように評価するか?(成功の度合い) | ||

人工物による模倣学習では、これらの課題のほとんどを事前決定しているケースが多い。Herman<ref name=Herman2002>'''[[w:Louis Herman|Louis M. Herman]] (2002).'''<br>Vocal, social, and self imitation by bottlenosed dolphins. In Kerstin Dautenhahn and Chrystopher L. Nehaniv, editors, Imitation in Animals and Artifacts, p. Chapter 3. The MIT Press. </ref>は、[[wj:ハンドウイルカ|ハンドウイルカ]]の興味ある模倣行動について報告している。視覚や聴覚を始めとする多様なモダリティや形態の模倣行動、トレーナーのジェスチャーによる模倣行動制御、そして自己模倣などが含まれる。彼らは、即時に同時に相互模倣すること、さらに人間のジェスチャーを模倣する際、異なる身体部位を使うが、模倣自体は的確に表現されている。ハンドウイルカは上記の5つの課題を巧妙に解いているように見える(後半で述べる計算論的な枠組みでは、これらの課題に直接結びつくアプローチも提案されており、後で触れる)。 | |||

これらは、特別のメカニズムによるのか、他者を含む環境との相互作用による創発行動なのかの議論がある。[[新生児模倣]]<ref name=Meltzoff1977><pubmed>897687</pubmed></ref>は、模倣の生得性を謳ったが、その後、多くの観察から、感覚運動学習の可能性が高くなっている(例えば、<ref name=Ray2011><pubmed>21159091</pubmed></ref>)。そして、'''図1'''でもすでに示されているように、模倣の進化の連続性の観点からは、共通のメカニズムとして、ミラーニューロンシステム<ref name=リゾラッティ2009>'''ジャコモ ・リゾラッティ&コラド・シニガリア, 柴田裕之 (訳), 茂木健一郎 (監修) (2009).'''<br>『ミラーニューロン』. 紀伊国屋書店. </ref>が重要な役割を果たしているように見える。ミラーニューロンは[[マカクザル]]の[[下前頭回]]([[F5領域]])と[[下頭頂葉]]で発見され、運動の観測と実行を司るニューロンと称されてきた。そして、先に示した共感やメンタライジング、さらには、ヒトの[[ブローカ野]]に近いこともあり、言語能力にも関連しているとさえ言われてきた<ref name=Rizzolatti1998><pubmed> 9610880 </pubmed></ref>。これらは、過渡の期待であり、多くの懸念を示す研究者もいる<ref name=Hickok2009><pubmed>19199415</pubmed></ref>。行為理解に無関係ではないが、そのような高次の機能を担っていないとも言われている<ref name=Hickok2013><pubmed>23147121</pubmed></ref>。ミラーニューロンシステムの定義自体にもよるが、ヒトのミラーニューロンシステムの解析では、Oosterhof et al. <ref name=Oosterhof2013><pubmed>23746574</pubmed></ref>は、multivariate pattern analysis (MVPA) <ref name=Mahmoudi2012><pubmed>23401720</pubmed></ref>を用いて、以下を示した('''図2'''も参照)。 | これらは、特別のメカニズムによるのか、他者を含む環境との相互作用による創発行動なのかの議論がある。[[新生児模倣]]<ref name=Meltzoff1977><pubmed>897687</pubmed></ref>は、模倣の生得性を謳ったが、その後、多くの観察から、感覚運動学習の可能性が高くなっている(例えば、<ref name=Ray2011><pubmed>21159091</pubmed></ref>)。そして、'''図1'''でもすでに示されているように、模倣の進化の連続性の観点からは、共通のメカニズムとして、ミラーニューロンシステム<ref name=リゾラッティ2009>'''ジャコモ ・リゾラッティ&コラド・シニガリア, 柴田裕之 (訳), 茂木健一郎 (監修) (2009).'''<br>『ミラーニューロン』. 紀伊国屋書店. </ref>が重要な役割を果たしているように見える。ミラーニューロンは[[マカクザル]]の[[下前頭回]]([[F5領域]])と[[下頭頂葉]]で発見され、運動の観測と実行を司るニューロンと称されてきた。そして、先に示した共感やメンタライジング、さらには、ヒトの[[ブローカ野]]に近いこともあり、言語能力にも関連しているとさえ言われてきた<ref name=Rizzolatti1998><pubmed> 9610880 </pubmed></ref>。これらは、過渡の期待であり、多くの懸念を示す研究者もいる<ref name=Hickok2009><pubmed>19199415</pubmed></ref>。行為理解に無関係ではないが、そのような高次の機能を担っていないとも言われている<ref name=Hickok2013><pubmed>23147121</pubmed></ref>。ミラーニューロンシステムの定義自体にもよるが、ヒトのミラーニューロンシステムの解析では、Oosterhof et al. <ref name=Oosterhof2013><pubmed>23746574</pubmed></ref>は、multivariate pattern analysis (MVPA) <ref name=Mahmoudi2012><pubmed>23401720</pubmed></ref>を用いて、以下を示した('''図2'''も参照)。 | ||

| 67行目: | 67行目: | ||

*[[腹側運動前野]]([[PMv]])は、視覚運動表現において、第三者視点よりも本人の視点からの応答が強かった。マカクザルでは、この該当領域([[F5]])において、自己他者の視点の違いによらない行動認識とされていたことと異なる。 | *[[腹側運動前野]]([[PMv]])は、視覚運動表現において、第三者視点よりも本人の視点からの応答が強かった。マカクザルでは、この該当領域([[F5]])において、自己他者の視点の違いによらない行動認識とされていたことと異なる。 | ||

*[[前頭頂間溝]]([[aIPS]])は、[[視覚]]、[[運動]]、および[[心象]]のモダリティ全体を一般化することに関して、最も一貫した行動のコーディングを示した。このことは、ヒトミラーニューロンシステムの基本的なハブの可能性が高い。 | *[[前頭頂間溝]]([[aIPS]])は、[[視覚]]、[[運動]]、および[[心象]]のモダリティ全体を一般化することに関して、最も一貫した行動のコーディングを示した。このことは、ヒトミラーニューロンシステムの基本的なハブの可能性が高い。 | ||

*[[外側後頭側頭皮質]]([[OT]] | *[[外側後頭側頭皮質]]([[OT]])の領域は、クロスモーダルでアクション固有、視点に依存しない行動表現を示している。伝統的にはこの領域は視覚の一部で、視覚運動、身体部位、物体形状などの隣接表現に関与してきたが、最近の多くの研究では、ハプティクス、運動行動、道具使用等の汎用領域であることを示唆する。よってこのOT領域は、ヒトミラーニューロンシステムの候補部分である。 | ||

*ミラーニューロンが(前)[[運動野]]で発見されたことで、[[前頭葉|前頭]][[頭頂葉|頭頂]]ヒトミラーニューロンシステムの直接マッピング機構仮説が唱えられたが、ヒトの運動野以外のクロスモーダルでアクション固有の表現が、上記の外側後頭側頭皮質や海馬にもあることが発見され、この仮説が不完全であることが明らかになった。 | *ミラーニューロンが(前)[[運動野]]で発見されたことで、[[前頭葉|前頭]][[頭頂葉|頭頂]]ヒトミラーニューロンシステムの直接マッピング機構仮説が唱えられたが、ヒトの運動野以外のクロスモーダルでアクション固有の表現が、上記の外側後頭側頭皮質や海馬にもあることが発見され、この仮説が不完全であることが明らかになった。 | ||

| 94行目: | 94行目: | ||

現在の逆強化学習で最も基礎となる手法は[[最大エントロピー原理]]に基づく方法<ref name=Ziebart2008>'''B D Ziebart, A Maas, J A Bagnell, and A K Dey (2008).'''<br>Maximum entropy inverse reinforcement learning. In Proc. of the 23rd AAAI Conference on Artificial Intelligence, pp. 1433-1438</ref>であり、これは強化学習の目的を単なる積算報酬最大化ではなく、方策の[[エントロピー]]を付与した報酬を最大化することに等しい。この方法は深層学習との統合も容易で、大規模なナビゲーション課題に適用された例<ref name=Wulfmeier2017>'''Markus Wulfmeier, Dushyant Rao, Dominic Zeng Wang, Peter Ondruska, and Ingmar Posner (2017).'''<br>Large-scale cost function learning for path planning using deep inverse reinforcement learning. International Journal of Robotics Research, 36:1073-87.</ref>もある。しかし最大エントロピー原理に基づく方法は環境の状態遷移確率が既知であると仮定していること、強化学習による方策最適化を繰り返し説くため計算効率が悪いことなどの問題点がある。 | 現在の逆強化学習で最も基礎となる手法は[[最大エントロピー原理]]に基づく方法<ref name=Ziebart2008>'''B D Ziebart, A Maas, J A Bagnell, and A K Dey (2008).'''<br>Maximum entropy inverse reinforcement learning. In Proc. of the 23rd AAAI Conference on Artificial Intelligence, pp. 1433-1438</ref>であり、これは強化学習の目的を単なる積算報酬最大化ではなく、方策の[[エントロピー]]を付与した報酬を最大化することに等しい。この方法は深層学習との統合も容易で、大規模なナビゲーション課題に適用された例<ref name=Wulfmeier2017>'''Markus Wulfmeier, Dushyant Rao, Dominic Zeng Wang, Peter Ondruska, and Ingmar Posner (2017).'''<br>Large-scale cost function learning for path planning using deep inverse reinforcement learning. International Journal of Robotics Research, 36:1073-87.</ref>もある。しかし最大エントロピー原理に基づく方法は環境の状態遷移確率が既知であると仮定していること、強化学習による方策最適化を繰り返し説くため計算効率が悪いことなどの問題点がある。 | ||

計算効率を大幅に改善した方法として、方策のエントロピーではなく、ベースライン方策の学習方策の[[相対エントロピー]]を用いた正則化に基づく方法が提案されている。特に[[線形可解マルコフ決定過程]] | 計算効率を大幅に改善した方法として、方策のエントロピーではなく、ベースライン方策の学習方策の[[相対エントロピー]]を用いた正則化に基づく方法が提案されている。特に[[線形可解マルコフ決定過程]]のもとでの逆強化学習法OptV<ref name=Dvijotham2010>'''Krishnamurthy Dvijotham and Emanuel Todorov (2010).'''<br>Proc. of the 27th international conference on machine learning. In Proc. of the 23rd AAAI Conference on Artificial Intelligence, pp. 335-42. </ref>は[[状態価値関数]]の推定を経ることで逆強化学習の困難さが大幅に緩和できることを示した。またOptVを密度比推定の問題として定式化することで、状態遷移確率を明示的に必要としないモデルフリー逆強化学習法<ref name=Uchibe2018>'''Eiji Uchibe (2018).'''<br>Model-free deep inverse reinforcement learning by logistic regression. Neural Processing Letters, 47:891-905. </ref>も開発された。Yamaguchi et al. <ref name=Yamaguchi2018><pubmed>29718905</pubmed></ref>は[[線虫]](C''aenorhabditis elegans''; ''C. elegans'')の[[温度走性行動]]をOptimize Value function (OptV)によって解析し、餌が十分ある状態で育った線虫は絶対温度と温度の時間微分に、飢餓状態で育った線虫は絶対温度のみに依存した報酬を感じていることを明らかにした。またAshida et al. <ref name=Ashida2019><pubmed>31082452</pubmed></ref>[43]は線虫の領域制限探索行動において[[ドーパミン]]が速度変化に影響を与えていることを示した。 | ||

===敵対的生成模倣学習に基づく方法=== | ===敵対的生成模倣学習に基づく方法=== | ||

2021年9月28日 (火) 21:21時点における版

浅田稔

大阪国際工科専門職大学,大阪大学先導的学際研究機構 共生知能システム研究センター

内部英治

株式会社国際電気通信基礎技術研究所 脳情報研究所

DOI:10.14931/bsd.9923 原稿受付日:2021年9月23日 原稿完成日:2021年9月28日

担当編集委員:五味 裕章(NTTコミュニケーション科学基礎研究所 人間情報研究部)

同義語:イミテーション・ラーニング

英:imitation learning 独:Imitationslernen

模倣学習とは、「模倣を学習すること」の意味と学習の一形態としての「模倣学習」が考えられる。前者では、模倣することの前提知識や条件が完全に与えられれば、学習する必要はなく、ブラインドコピーすることで終わる。これらの前提知識や条件が不備であるとき、それらを埋めるべき操作としての学習過程が必要となる。後者は、教師あり学習、教師なし学習、強化学習などの代表的な学習のアプローチの中で、従来、教師あり学習の一形態として模倣学習が位置づけられてきたが、近年、強化学習の報酬関数の推定の観点から逆強化学習が注目され、さらに深層学習の各種法の適用により、計算論的観点から模倣学習が見直され、拡張されている。

はじめに

本辞典の項目「模倣」でも示されているように、その定義や課題は、環境、タスク、(被)模倣エージェントの仕様や能力(ハードとソフト)により多様かつ深淵であり、認知心理学や神経科学の観点はもとより、知的人工物設計の観点からも興味深い。後者の構成的手法(文献[1]など参照)により、前者の仮説検証も期待される。本項目では、前半に構成的手法の視点から模倣学習を可能な限り幅広く捉え、模倣学習を概観する。切り口として、文献[2]の模倣の機能構成を示し、そこで定義されている真の模倣と疑似模倣の関係を明らかにし、人工物としての模倣の意味や意義、可能性を論じる。特に行為理解に関わるミラーニューロンやミラーニューロンシステムについて、イメージング研究からその役割を検討する。

後半では、学習の一手法としての観点から「模倣学習」を見直す。銅谷[3]が示しているように、小脳、大脳基底核、大脳の脳の各部位に対応して、教師あり学習、強化学習、教師なし学習の分類がなされており、従来、模倣学習は被模倣者からの提示が、意図的かどうかに関わらず、教示と捉えられ、教師あり学習の一つとみなされてきた。しかし、教示から報酬予測する逆強化学習の手法が、近年の深層学習の興隆も相まって、注目されている。そこで、計算論的視点から、逆強化学習とその周辺の動向を探り、模倣学習としての可能性について論じる。特に、前者の模倣学習の課題をどこまで解決可能で、これからの課題が何であるを示す。

模倣の構造

模倣とは

- 行動観察に基づく最も基本的な行動能力であり、他者の行動を認識し何らかの理解が出来ている証拠、

- 理解のレベルに応じて様々なレベル、

- 専門家による再プログラミングなしに、新たな行動技能を獲得できる。独自に膨大な試行錯誤学習をするよりはるかに効率的で実用的、

とされ[2]、それを支える機能として、運動認識、動作認識、行動認識、身体と物体の理解、目的や意図の推定、行為認識、予測が挙げられ、自己との対応付けなどを経て行為理解に至る。これらは、知能の根源に関わる重要かつ、一般に実現が困難な機能ばかりである。運動、動作、行為、行動などの定義については、付録参照。

模倣の機能的な構成

上で示した理解のレベルは、身体的模倣、行動単位模倣、目的行為模倣に分かれ、階層構造をなし、以降の模倣構造のベースとなっている。最上位の目的行為模倣は、他者の行為の構造と意味の理解に基づく新奇行動の獲得を意味し、表面的に他者と同じ行動を見せても、新奇性がない場合や、行動認識が行動生成と直接因果関係をもたない場合は疑似模倣と称され、それは、反応促進、刺激強化、目的再現の三つがあり、それらの関係を表1にまとめた。

- 刺激強化(stimulus enhancement or local enhancement):他者の行動を見て、その場所や対象物に注意を惹かれ、自分でもそれらに働きかけて、結果的に同様な行動をする場合で、意図的な教示者からすれば、観察者を特定の刺激にさらし、観察者が刺激とその結果の関係を学習するように導く。

- 目的再現(goal emulation):他者の行動を見て、その目的を共有し、試行錯誤学習で結果的に同じ行動をする場合

- 反応促進(response facilitation):あくびに代表される、つられ行動で、他者の行動に直接呼応する行動でも、それが自己の既存の行動単位を活性化し、非意図的に、新奇でない同じ行動を引き起こす場合とされる。

| 真の模倣 | 上位疑似模倣 | 下位疑似模倣 | 例 | 病的症状 | 関連機能 | 獲得能力 |

|---|---|---|---|---|---|---|

| 目的行為模倣 | 掃除、手助け、逆強化学習 | 他者心的状態推定、行動認識 | 行為認識、目的や意図の推定、行為理解、予測、自己との対応付け | |||

| 行動単位模倣 | 箒で掃く | 共同注意、運動認識 | 動作認識、身体と物体の粗い理解 | |||

| 反応促進 | つられ、群行動 | 反響症状 | 身体性、行動創発、随意と反射、協応 | |||

| 刺激強化 | 物のもてあそび | 強迫的道具使用 | アフォーダンス・機会、主観的行動 | |||

| 目的再現 | 試行錯誤、強化学習 |

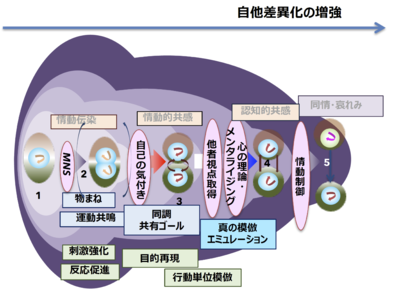

これらは、主に動物行動学の観点からの区分であり、de Waalによる共感のロシア人形モデル([4])では、刺激強化や反応促進などは、物まね(motor mimicry)や運動共鳴(motor resonance)などにつながる。また、目的再現は、真の模倣に近い「共有ゴール」に位置づけされ、これらの発達・進化の過程が共感及び自他認知の発達進化と並行することが唱えられている。Asada[5]は、人工共感の発達モデルとして、これらを組み込んでいる(図1)。

文献[5]のFig. 6と文献[4]のFig. 2を組み合わせ改編し、文献[2]の図6.2の真/疑似模倣を加えた。

動物における模倣とミラーニューロンシステム

Dautenhahn and Nehaniv [6]は、エージェントの観点から動物と人工物の模倣研究を束ねており、その第一章[7]において、共通メカニズムに言及しており、社会的・文化的環境の影響の大きさを指摘している。野生ではあまり模倣行動を表出しない動物でも、人間と一緒に生活経験の長い動物は、模倣行動を表出しやすいことが観察されている。動物行動学の観点も含めて、人工物が模倣行動を学習するときの5つの大課題として、以下が挙げられている。

- 誰を模倣するか?(誰がいい教師か?学習者が教師になれるか?)

- いつ模倣するか?(遊びのコンテキスト、教示、探索など)

- 何を模倣するか(状態、行動、ゴール、結果)

- 観察した行動から模倣行動をどのようにマップするか?(対応付け問題)

- 模倣の試みの成否をどのように評価するか?(成功の度合い)

人工物による模倣学習では、これらの課題のほとんどを事前決定しているケースが多い。Herman[8]は、ハンドウイルカの興味ある模倣行動について報告している。視覚や聴覚を始めとする多様なモダリティや形態の模倣行動、トレーナーのジェスチャーによる模倣行動制御、そして自己模倣などが含まれる。彼らは、即時に同時に相互模倣すること、さらに人間のジェスチャーを模倣する際、異なる身体部位を使うが、模倣自体は的確に表現されている。ハンドウイルカは上記の5つの課題を巧妙に解いているように見える(後半で述べる計算論的な枠組みでは、これらの課題に直接結びつくアプローチも提案されており、後で触れる)。

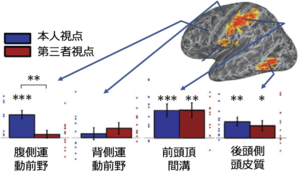

これらは、特別のメカニズムによるのか、他者を含む環境との相互作用による創発行動なのかの議論がある。新生児模倣[9]は、模倣の生得性を謳ったが、その後、多くの観察から、感覚運動学習の可能性が高くなっている(例えば、[10])。そして、図1でもすでに示されているように、模倣の進化の連続性の観点からは、共通のメカニズムとして、ミラーニューロンシステム[11]が重要な役割を果たしているように見える。ミラーニューロンはマカクザルの下前頭回(F5領域)と下頭頂葉で発見され、運動の観測と実行を司るニューロンと称されてきた。そして、先に示した共感やメンタライジング、さらには、ヒトのブローカ野に近いこともあり、言語能力にも関連しているとさえ言われてきた[12]。これらは、過渡の期待であり、多くの懸念を示す研究者もいる[13]。行為理解に無関係ではないが、そのような高次の機能を担っていないとも言われている[14]。ミラーニューロンシステムの定義自体にもよるが、ヒトのミラーニューロンシステムの解析では、Oosterhof et al. [15]は、multivariate pattern analysis (MVPA) [16]を用いて、以下を示した(図2も参照)。

- 腹側運動前野(PMv)は、視覚運動表現において、第三者視点よりも本人の視点からの応答が強かった。マカクザルでは、この該当領域(F5)において、自己他者の視点の違いによらない行動認識とされていたことと異なる。

- 前頭頂間溝(aIPS)は、視覚、運動、および心象のモダリティ全体を一般化することに関して、最も一貫した行動のコーディングを示した。このことは、ヒトミラーニューロンシステムの基本的なハブの可能性が高い。

- 外側後頭側頭皮質(OT)の領域は、クロスモーダルでアクション固有、視点に依存しない行動表現を示している。伝統的にはこの領域は視覚の一部で、視覚運動、身体部位、物体形状などの隣接表現に関与してきたが、最近の多くの研究では、ハプティクス、運動行動、道具使用等の汎用領域であることを示唆する。よってこのOT領域は、ヒトミラーニューロンシステムの候補部分である。

- ミラーニューロンが(前)運動野で発見されたことで、前頭頭頂ヒトミラーニューロンシステムの直接マッピング機構仮説が唱えられたが、ヒトの運動野以外のクロスモーダルでアクション固有の表現が、上記の外側後頭側頭皮質や海馬にもあることが発見され、この仮説が不完全であることが明らかになった。

加えて、クロスモーダルでアクション固有に応答するニューロンは従来唱えられていたミラーニューロンのメインの領域である前頭頂ネットワーク以外にも多く存在する[15]。例えば、てんかん患者21人のある行動の観察や実行時に対して、観察と実行の両方に反応する細胞が観測されている領域として、補足運動野、海馬傍回、海馬が挙げられ[17]、情動や記憶とも密接に関連していると察せられる。その他の多くの領域においても、先の三領域ほど強くないが、観測されており、これらの領域では、より抽象的な表現がコードされ、一般的な連想機構が想定される。これらのことから、ミラーニューロンが特別なニューロンではなく、クロスモーダル性を示す多様なニューロン群の一種であり、マカクザルの場合は、他動詞的動作だったものが、ヒトの場合、自動詞的動作も含めた、より一般的な模倣行動生成メカニズムを、これらの多様なニューロン群が連携して実現しているとみなせる。これが、狭義のミラーニューロンが行動理解を担っていないという主張[14]と一致する。

ヒトの場合、広範なネットワーク構造により、疑似模倣から真の模倣に至る発達過程を通じて、文化的・社会的環境の下で多様な模倣行動を表出していると考えられる。

ミラーニューロン、逆強化学習の脳内実装

Collette et al. [18]はヒトが単純な模倣戦略を行っているのか、それとも逆強化学習によって他者の意図を推定する抽象的なプロセスを通して模倣しているかを明らかにするための機能的磁気共鳴機能画像法 (functional magnetic resonance imaging、fMRI)実験を実施した。その結果、左下頭頂葉後方(posterior inferior parietal lobe; temporo-parietal junction、 TPJ) /上側頭溝後部(posterior superior temporal sulcus、pSTS)と左背内側前頭前野(dorsomedial prefrontal cortex、 dmPFC)を含むメンタライジングネットワークと、前背側線条体と前補足運動野(presupplementary motor area、 pre-SMA)を含む目標指向学習に関与する脳領域のネットワークの二つが関与していることが示唆された。

一方でNajar et al.は教示者の報酬を推定し、それを行動のバイアスとして使用する逆強化学習に基づく模倣ではなく、教示者の行動が学習者の価値関数に直接影響を与える価値形成が模倣の計算モデルとして尤もらしいと報告した[19]。Charpentier et al。は単純な模倣と目的再現に基づく模倣が共存し、それぞれのシステムの予測の相対的な不確実性に基づいて調停されていることを報告した[20]。

人工システムによる模倣学習

反応促進や刺激強化は自動模倣(automatic imitation) と呼ばれ、無意識的行動として捉えられる。生得的か生後の感覚運動学習かの区別を明に付ける必要はないが、人工システムとしては、反射的な運動のライブラリを埋め込み、それをもとに環境内で体験から再帰的に構築していくことが考えられる。模倣ではないが、関連する研究として、周期的音刺激に神経振動子による引き込みで現象を利用(同調)してドラムを叩くロボットの例[21]がある。より一般的には、行動レパートリを用意し、自発的に行動が発現する方式をニューラルネットワークでモデル化した例もある[22]。また、Dynamic Movement Primitives (DMP) によるアプローチもある[23][24]。

刺激強化は物体や環境がトリガーとして働いて行動が生成される原理と考えられる。ものを見るとその操作行動を連想する機構は、我々人間に備わっているが、それはアフォーダンスがキーとなっている。ミラーニューロンシステムの計算論的神経科学の観点からモデル化を狙ったのは、Oztop and Arbib [25]で、アフォーダンスの機構が中心的な役割を果たしており、興味深い。アフォーダンスを学習するロボット研究としては、一定方向の回転する物体に対する研究がある[26]。また、身体表現の獲得と統合する試みもある[27]。

工学的応用の視点も含めた初期のパイオニア的研究としては、Kuniyoshi et al. [28]が挙げられ、組み立てタスクを例に人工システムの模倣学習の構造を明らかにした。これが、前節の模倣構造の原点となっている。ヒトを始めとする動物の模倣学習や発達における動作主体、目的共有、行為理解などの高次の認知機能や概念は設計者がロボットに与え、ロボットは軌道を追従したり、動作プリミティブの再生などのレベルに留まっているものが多い(例えば、[29][30][30]など)。Billard et al. [31]は、Learning from Demonstration (LfD)と呼び、工学的観点から模倣学習を概観している。確率ロボティクスの観点から模倣学習へのアプローチに関しては、杉浦の解説[32]が参考になる。強化学習の観点から、模倣学習の定式化を狙ったのは。Argall et al. [33]で、Programming by Demonstration (PbD)と呼び、教示例からの方策獲得過程としてまとめている。近年の深層学習の興隆により、強化学習の枠組みにおける報酬予測の観点から、逆強化学習が注目されている。

逆強化学習の枠組みでは、最大エントロピー原理に基づく手法や、さらに効率的にサンプリングや計算する手法が提案されており、解説[34][35][36]で紹介されている。特に、敵対的生成ネットワークの定式化を用いて、教示者と学習者の状態行動対を分類する識別器とそれを騙そうとする生成器の駆け引きとして強化学習と逆強化学習を組み合わせる手法は、深層学習が強化学習に深く入り込んで、深層学習が様々な学習に単なるツールとしてだけではなく、新たな枠組みを提案しているように捉えられる。さらに、逆強化学習で必要とされる教示者の状態行動列を必要とせず、ゴール状態のみを提示することで、報酬を推定する手法もある[37]。次節では、これらを含めた計算論的枠組について説明する。

逆強化学習による模倣学習の定式化

最大エントロピー原理に基づく方法

逆強化学習は教示者の方策または教示者が環境と相互作用することによって得られる状態行動対の集合から、教示者の方策を最もうまく説明する報酬を推定する枠組みである。逆強化学習は不良設定問題であり、一般には唯一解をもたない。そのため様々な正則化法が提案されている。

現在の逆強化学習で最も基礎となる手法は最大エントロピー原理に基づく方法[38]であり、これは強化学習の目的を単なる積算報酬最大化ではなく、方策のエントロピーを付与した報酬を最大化することに等しい。この方法は深層学習との統合も容易で、大規模なナビゲーション課題に適用された例[39]もある。しかし最大エントロピー原理に基づく方法は環境の状態遷移確率が既知であると仮定していること、強化学習による方策最適化を繰り返し説くため計算効率が悪いことなどの問題点がある。

計算効率を大幅に改善した方法として、方策のエントロピーではなく、ベースライン方策の学習方策の相対エントロピーを用いた正則化に基づく方法が提案されている。特に線形可解マルコフ決定過程のもとでの逆強化学習法OptV[40]は状態価値関数の推定を経ることで逆強化学習の困難さが大幅に緩和できることを示した。またOptVを密度比推定の問題として定式化することで、状態遷移確率を明示的に必要としないモデルフリー逆強化学習法[41]も開発された。Yamaguchi et al. [42]は線虫(Caenorhabditis elegans; C. elegans)の温度走性行動をOptimize Value function (OptV)によって解析し、餌が十分ある状態で育った線虫は絶対温度と温度の時間微分に、飢餓状態で育った線虫は絶対温度のみに依存した報酬を感じていることを明らかにした。またAshida et al. [43][43]は線虫の領域制限探索行動においてドーパミンが速度変化に影響を与えていることを示した。

敵対的生成模倣学習に基づく方法

相対エントロピーを用いた方法はベースライン方策の選択が結果に重大な影響を及ぼす。学習前または初心者の方策をベースラインとして採用するのが一般的であるが、教示者の方策と大きく異なる場合にはうまく報酬が推定できない。そこで逆強化学習で推定された報酬をもとに方策を改善し新たなベースライン方策として用いる方法が開発され、敵対的生成ネットワークとして解釈できることが報告された[44][45]。前述したように、逆強化学習は密度比推定の問題に帰着できるが、これは教示者が生成した状態行動対と学習者が生成した状態行動対を区別する二値分類の問題と等価で、敵対的生成ネットワークの識別器に対応する。一方、推定された報酬から方策を改善する強化学習は、データを生成する分布を調整する敵対的生成ネットワークの生成器に対応する。

敵対的生成模倣学習と通常の敵対的生成ネットワークの大きな違いの一つは識別器を構造化できる点にある。一般に最適な識別器は教示者と学習者のデータ生成分布の密度比によって表現できるが、工学的なシステムにおいては学習者のデータ生成分布は実験者が明示的に規定できる。この事実とエントロピー正則の導入によって、識別器は報酬、状態価値関数、および学習者の方策によって構造化できる[41][46]。エントロピー正則のもとで導出された識別器は強化学習と行動のランダムさなどのハイパーパラメータを共有化できるため、学習の進捗に応じて識別器の性能を調整できるなどの利点がある[47]。

おわりに

模倣学習について概観した。前半では、ヒトや動物における模倣学習の構造、ならびに人工システムによる模倣学習について説明した。特に後者では、工学的応用の観点から軌道の再生、行動表出に主眼が置かれた。後半では、深層学習の応用としての逆強化学習による模倣学習の定式化がなされた。これらは新たな視点からの模倣学習の再構築が試みられており、今後も期待したい反面、模倣主体の動機づけ、行動目的の理解と共有、さらには共感などの高次の認知機能との連携が望まれる。

付録:運動、行動、行為などの定義

「ロボットの動きに関わる言葉として、以下のように様々なものがある[2]。その定義は、研究者の間でも必ずしも一致せず、研究分野によっても異なるが、一つの整理の仕方を挙げておく。多くの場合、あまり厳密に区別して使われないが、行為認識などの理論を検討するときには区別が重要になる。」

- 主体 (agent):「~を発生し司るもの」(~には動作、行為、行動などがはいる)。生物やロボットの総称と思えばよい。

- 運動 (movement):空間中における物体の連続的な位置姿勢変化や形状変化と振動。。物理学用語での運動と同じ。方向、速度、軌道、振幅、周波数などを持つ。

- 動作 (motion):主体が発生する運動で、関係性(何かに向かう/離れるなど)、定型性や周期性(同じ運動を繰り返すなど)などの観点で一貫した単位ごとに分節化(articulation / segmentation:区切ること) でき、ある単位から別の単位への変化があるもの(そこに主体性がある)。(一般には行為(action) と区別されずに使われることも多い。)

- 行為 (action):主体が意図する目的と、その達成にむけて発生する(一連の)動作とその結果、およびそれら(目的、動作、結果)を結ぶ因果関係からなる一まとまりの構造[3]。行為の主体を行為主体(actor / action agent)と呼ぶ。(英語のaction は、下記の行動の意味で使うことも多い)

- 行動 (behavior):行為のうち、外部から観測可能な部分、すなわち、(一連の)動作とその結果。(結果を含めずに動作の部分だけを指すことも多い。また、日本語ではaction の訳として「行動」を使うことも多い。観測者の視点からは行為と行動の区別はない。)「行動する主体」を行動主体または行動体(behavior agent) というが、この呼び方においては、主体の意図や判断などの内部状態や内部機構を特定しない。

- 振舞い (behavior):一定の環境・状況のもとで同一の主体が発生する(一連の)行動。環境、状況、主体のどれかが変われば別の振舞いとなる。「行動」より時空間的に広がりがあるが、「行動」と同義に使うことも多い。

関連項目

参考文献

- ↑ Minoru Asada, Koh Hosoda, Yasuo Kuniyoshi, Hiroshi Ishiguro, Toshio Inui, Yuichiro Yoshikawa, Masaki Ogino, and Chisato Yoshida (2009).

Cognitive developmental robotics: a survey. IEEE Transactions on Autonomous Mental Development, 1:12-34. - ↑ 2.0 2.1 2.2 2.3 2.4 浅田稔、國吉康夫 (2006).

『ロボットインテリジェンス』. 岩波書店 - ↑ 3.0 3.1 銅谷賢治 (2007).

計算神経科学への招待 : 脳の学習機構 の理解を目指して. サイエンス社 - ↑ 4.0 4.1

de Waal, F.B. (2008).

Putting the altruism back into altruism: the evolution of empathy. Annual review of psychology, 59, 279-300. [PubMed:17550343] [WorldCat] [DOI] - ↑ 5.0 5.1 Minoru Asada (2015).

Towards artificial empathy. International Journal of Social Robotics. 7:19-33. - ↑ Kerstin Dautenhahn and Chrystopher L. Nehaniv (eds.). (2002).

Imitation in Animals and Artifacts. The MIT Press. - ↑ Kerstin Dautenhahn and Chrystopher L. Nehaniv (2002).

The agent-based perspective on imitation. In Kerstin Dautenhahn and Chrystopher L. Nehaniv, editors, Imitation in Animals and Artifacts, Chapter 1. The MIT Press. - ↑ Louis M. Herman (2002).

Vocal, social, and self imitation by bottlenosed dolphins. In Kerstin Dautenhahn and Chrystopher L. Nehaniv, editors, Imitation in Animals and Artifacts, p. Chapter 3. The MIT Press. - ↑

Meltzoff, A.N., & Moore, M.K. (1977).

Imitation of facial and manual gestures by human neonates. Science (New York, N.Y.), 198(4312), 74-8. [PubMed:897687] [WorldCat] [DOI] - ↑

Ray, E., & Heyes, C. (2011).

Imitation in infancy: the wealth of the stimulus. Developmental science, 14(1), 92-105. [PubMed:21159091] [WorldCat] [DOI] - ↑ ジャコモ ・リゾラッティ&コラド・シニガリア, 柴田裕之 (訳), 茂木健一郎 (監修) (2009).

『ミラーニューロン』. 紀伊国屋書店. - ↑

Rizzolatti, G., & Arbib, M.A. (1998).

Language within our grasp. Trends in neurosciences, 21(5), 188-94. [PubMed:9610880] [WorldCat] [DOI] - ↑

Hickok, G. (2009).

Eight problems for the mirror neuron theory of action understanding in monkeys and humans. Journal of cognitive neuroscience, 21(7), 1229-43. [PubMed:19199415] [PMC] [WorldCat] [DOI] - ↑ 14.0 14.1

Hickok, G. (2013).

Do mirror neurons subserve action understanding? Neuroscience letters, 540, 56-8. [PubMed:23147121] [PMC] [WorldCat] [DOI] - ↑ 15.0 15.1 15.2

Oosterhof, N.N., Tipper, S.P., & Downing, P.E. (2013).

Crossmodal and action-specific: neuroimaging the human mirror neuron system. Trends in cognitive sciences, 17(7), 311-8. [PubMed:23746574] [WorldCat] [DOI] - ↑

Mahmoudi, A., Takerkart, S., Regragui, F., Boussaoud, D., & Brovelli, A. (2012).

Multivoxel pattern analysis for FMRI data: a review. Computational and mathematical methods in medicine, 2012, 961257. [PubMed:23401720] [PMC] [WorldCat] [DOI] - ↑

Mukamel, R., Ekstrom, A.D., Kaplan, J., Iacoboni, M., & Fried, I. (2010).

Single-neuron responses in humans during execution and observation of actions. Current biology : CB, 20(8), 750-6. [PubMed:20381353] [PMC] [WorldCat] [DOI] - ↑

Collette, S., Pauli, W.M., Bossaerts, P., & O'Doherty, J. (2017).

Neural computations underlying inverse reinforcement learning in the human brain. eLife, 6. [PubMed:29083301] [PMC] [WorldCat] [DOI] - ↑

Najar, A., Bonnet, E., Bahrami, B., & Palminteri, S. (2020).

The actions of others act as a pseudo-reward to drive imitation in the context of social reinforcement learning. PLoS biology, 18(12), e3001028. [PubMed:33290387] [PMC] [WorldCat] [DOI] - ↑

Charpentier, C.J., Iigaya, K., & O'Doherty, J.P. (2020).

A Neuro-computational Account of Arbitration between Choice Imitation and Goal Emulation during Human Observational Learning. Neuron, 106(4), 687-699.e7. [PubMed:32187528] [PMC] [WorldCat] [DOI] - ↑ 琴坂信哉、S. Schaal (2001).

神経振動子を用いたロボッ トのリズミックな運動生成. 日本ロボット学会誌, 19:116-123. - ↑

Tani, J., Ito, M., & Sugita, Y. (2004).

Self-organization of distributedly represented multiple behavior schemata in a mirror system: reviews of robot experiments using RNNPB. Neural networks : the official journal of the International Neural Network Society, 17(8-9), 1273-89. [PubMed:15555866] [WorldCat] [DOI] - ↑ A. J. Ijspeert, J. Nakanishi, and S. Schaal (2002).

Learning rhythmic movements by demonstration using nonlinear oscillators. In Proc. of IEEE/RSJ International Conference on Intelligent Robots and Systems 2002 (IROS '02), pp. 958-963. - ↑ Takamitsu Matsubara, Sang-Ho Hyon, and Jun Morimoto (2010).

Learning stylistic dynamic movement primitives from multiple demonstrations. In 2010 IEEE/RSJ International Conference on Intelligent Robots and Systems, pp. 1277-1283 - ↑

Oztop, E., & Arbib, M.A. (2002).

Schema design and implementation of the grasp-related mirror neuron system. Biological cybernetics, 87(2), 116-40. [PubMed:12181587] [WorldCat] [DOI] - ↑ Paul Fitzpatrick, Giorgio Metta, Lorenzo Natale, Sajit Rao, and Giulio Sandini (2003).

Learning about objects through action - initial steps towards artificial cognition. In Proc. of IEEE Int. Conf. on Robotics and Automation, pp. 3140-3145, 2003. - ↑ Y. Kuniyoshi, Y. Yorozu, Y. Ohmura, K. Terada, T. Otani, A. Nagakubo, and T. Yamamoto (2004).

From humanoid embodiment to theory of mind. In F. Iida, R. Pfeifer, L. Steels, and Y. Kuniyoshi, editors, Embodied Artificial Intelligence, pp. 202- 218. Springer, Lecture Note in Artificial Intelligence 3139 (Berlin). - ↑ Y. Kuniyoshi, M. Inaba, and H. Inoue (1994).

Learning by watching. IEEE Trans. on R&A, 10:799-822. - ↑

Kawato, M., Wada, Y., Nakano, E., Osu, R., Koike, Y., Gomi, H., ..., & Miyamoto, H. (1996).

A Kendama Learning Robot Based on Bi-directional Theory. Neural networks : the official journal of the International Neural Network Society, 9(8), 1281-1302. [PubMed:12662536] [WorldCat] [DOI] - ↑ 30.0 30.1

Schaal, S., Ijspeert, A., & Billard, A. (2003).

Computational approaches to motor learning by imitation. Philosophical transactions of the Royal Society of London. Series B, Biological sciences, 358(1431), 537-47. [PubMed:12689379] [PMC] [WorldCat] [DOI] - ↑ A. Billard, S. Calinon, R. Dillmann, and S. Schaal (2008).

Survey: Robot programming by demonstration. Springer Handbook of Robotics, pp. 1371-1394. Book winner of 2 PROSE awards (Award for Excellence in Physical Sciences & Mathematics, Award for Engineering & Technology). - ↑ 杉浦孔明 (2016).

模倣学習における確率ロボティクスの新展開. システム/制御/情報, 60:521- 527. - ↑ Brenna D. Argall, Sonia Chernova, Manuela Veloso, and Brett Browning (2009).

A survey of robot learning from demonstration. Robotics and Autonomous Systems, 57:469-483. - ↑ 長井隆行、堀井隆斗 (2020).

強化学習とロボティクス. 電子情報通信学会誌, 103:1239-1247 - ↑ N. Ab Aza, A. Shahmansoorian, and M. Davoudi (2020).

From inverse optimal control to inverse reinforcement learning: A historical review. Annual Reviews in Control, 50:119-138. - ↑ S. Arora and P. Doshi (2021).

A survey of inverse reinforcement learning: Challenges, methods and progress. Artificial Intelligence. - ↑ Justin Fu, Avi Singh, Dibya Ghosh, Larry Yang, and Sergey Levine (2018).

Variational inverse control with events: a general framework for data-driven reward definition. In Neural Information Processing Systems (NIPS), 2018, pp. 8547-8556 - ↑ B D Ziebart, A Maas, J A Bagnell, and A K Dey (2008).

Maximum entropy inverse reinforcement learning. In Proc. of the 23rd AAAI Conference on Artificial Intelligence, pp. 1433-1438 - ↑ Markus Wulfmeier, Dushyant Rao, Dominic Zeng Wang, Peter Ondruska, and Ingmar Posner (2017).

Large-scale cost function learning for path planning using deep inverse reinforcement learning. International Journal of Robotics Research, 36:1073-87. - ↑ Krishnamurthy Dvijotham and Emanuel Todorov (2010).

Proc. of the 27th international conference on machine learning. In Proc. of the 23rd AAAI Conference on Artificial Intelligence, pp. 335-42. - ↑ 41.0 41.1 Eiji Uchibe (2018).

Model-free deep inverse reinforcement learning by logistic regression. Neural Processing Letters, 47:891-905. - ↑

Yamaguchi, S., Naoki, H., Ikeda, M., Tsukada, Y., Nakano, S., Mori, I., & Ishii, S. (2018).

Identification of animal behavioral strategies by inverse reinforcement learning. PLoS computational biology, 14(5), e1006122. [PubMed:29718905] [PMC] [WorldCat] [DOI] - ↑

Ashida, K., Kato, T., Hotta, K., & Oka, K. (2019).

Multiple tracking and machine learning reveal dopamine modulation for area-restricted foraging behaviors via velocity change in Caenorhabditis elegans. Neuroscience letters, 706, 68-74. [PubMed:31082452] [WorldCat] [DOI] - ↑ Chelsea Finn, Paul Christiano, Pieter Abbeel, and Sergey Levine (2016).

A connection between gener- ative adversarial networks, inverse reinforcement learning, and energy-based models. In NIPS 2016 Workshop on Adversarial Training. - ↑ Jonathan Ho and Stefano Ermon (2016).

Generative adversarial imitation learning. In D. Lee, M. Sugiyama, U. Luxburg, I. Guyon, and R. Garnett, editors, Advances in Neural Information Processing Systems, Vol. 29. Curran Associates, Inc. - ↑ Justin Fu, Katie Luo, and Sergey Levine (2018).

Learning robust rewards with adversarial inverse reinforcement learning. In Proc. of the 6th International Conference on Learning Representations. - ↑

Uchibe, E., & Doya, K. (2021).

Forward and inverse reinforcement learning sharing network weights and hyperparameters. Neural networks : the official journal of the International Neural Network Society, 144, 138-153. [PubMed:34492548] [WorldCat] [DOI]